这个例子简单的阐述了TensorFlow当中如何用代码来运行我们搭建的结构

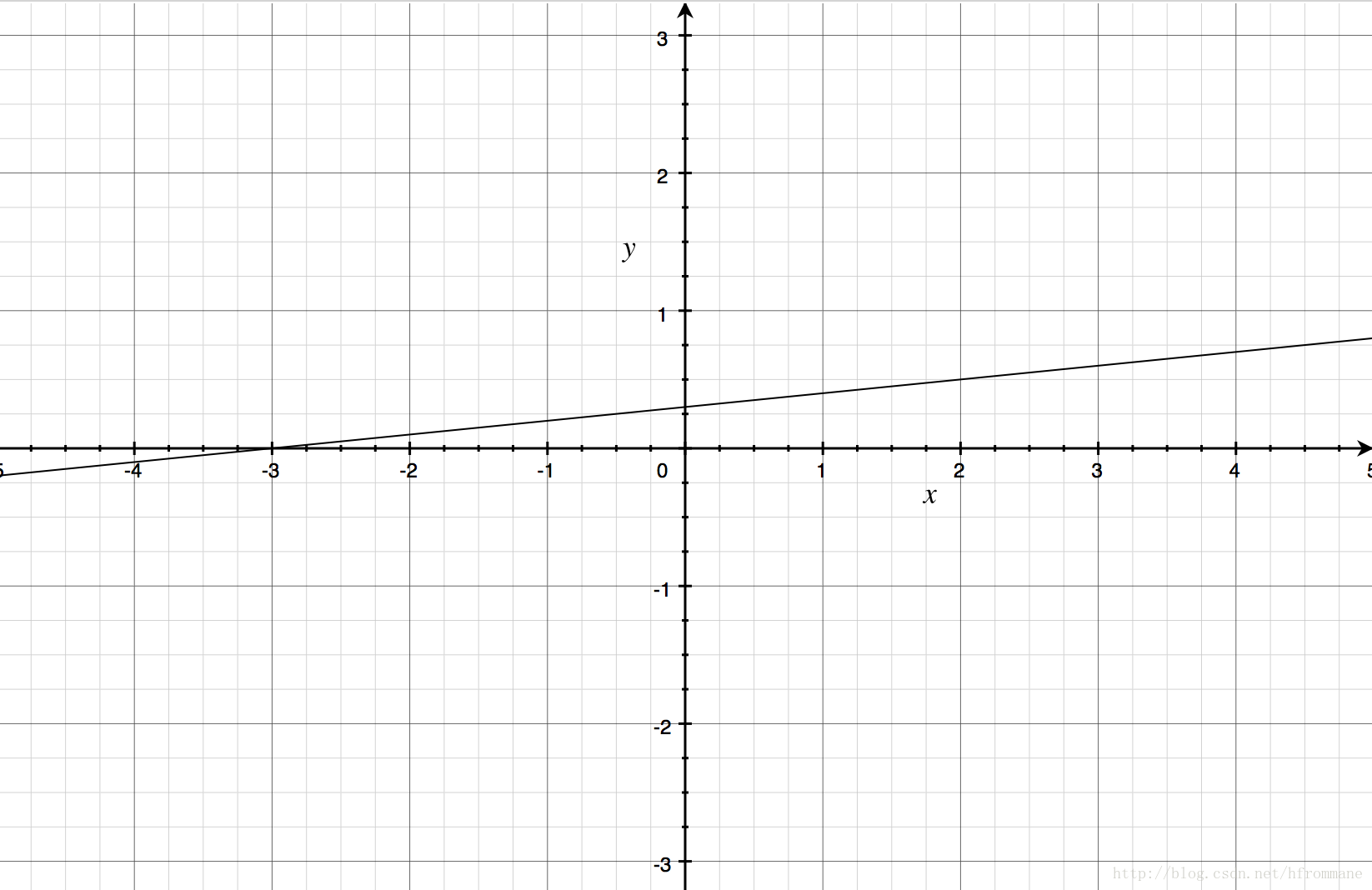

直线的表达式为:y = a*x + b 其中x代表inputs,y代表outputs,a和b是神经网络训练的参数。模型训练好了以后,a和b的值将会被确定,比如 a=0.1,b=0.3,当我们再输入x=3时,我们的模型就会输出 0.6 的结果。模型通过学习,得到能表达数据的参数,然后对我们另外给的数据作出预测。

首先, 我们这次需要加载 tensorflow 和 numpy 两个模块,并且使用 numpy 来创建我们的数据。

import tensorflow as tf

import numpy as np

# 创建数据,y_data为真实的结果。

x_data = np.random.rand(100).astype(np.float32)

y_data = x_data * 0.1 + 0.3接着,我们用 tf.Variable 来创建描述 y 的参数。我们可以把 y_data = x_data*0.1 + 0.3 想象成 y=Weights * x + biases,然后神经网络也就是学着把 Weights 变成 0.1,biases 变成 0.3。

Weights = tf.Variable(tf.random_uniform([1], -1.0, 1.0))

biases = tf.Variable(tf.zeros([1]))

y = Weights * x_data + biases接着就是计算 y 和 y_data 的误差:

loss = tf.reduce_mean(tf.square(y - y_data))我们使用反向传播误差的方法是梯度下降:GradientDescentOptimizer,然后我们使用 optimizer 来更新参数。

optimizer = tf.train.GradientDescentOptimizer(0.5)

train = optimizer.minimize(loss)到目前为止,我们只是建立了神经网络的结构,还没有使用这个结构。在使用这个结构之前,我们必须先初始化之前定义的所有Variable。

init = tf.initialize_all_variables()最后,我们再创建会话 Session。我们用 Session 来执行 init ,初始化参数。并用 Session 来 run 每一次 training 的数据,逐步提升神经网络的准确性。

session = tf.Session()

session.run(init)

for step in range(201):

session.run(train)

if step % 20 == 0:

print(step, session.run(Weights), session.run(biases), session.run(loss))程序运行结果:

000 [ 0.38761616] [ 0.19455409] 0.008414230

020 [ 0.17776486] [ 0.25661391] 0.000470390

040 [ 0.12288877] [ 0.28723004] 4.07509e-05

060 [ 0.10673694] [ 0.29624140] 3.53033e-06

080 [ 0.10198288] [ 0.29889372] 3.05838e-07

100 [ 0.10058364] [ 0.29967439] 2.64955e-08

120 [ 0.10017177] [ 0.29990417] 2.29497e-09

140 [ 0.10005056] [ 0.29997179] 1.98841e-10

160 [ 0.10001489] [ 0.29999170] 1.72525e-11

180 [ 0.10000439] [ 0.29999757] 1.49941e-12

200 [ 0.10000130] [ 0.29999930] 1.30438e-13结论:

可以看到:Weights已经接近0.1,biases已经接近0.3了。loss也已经很小很小了,我们的训练取得了很好的效果。