2025年2月21日,北京——蓝耘元生代推理引擎最近正式上线了其全新的DeepSeek R1/V3满血版,作为一站式AI应用开发平台,这一版本的上线引发了开发者和企业用户的广泛关注和热烈反馈。DeepSeek R1/V3不仅提供了高性能的大模型推理能力,而且支持在线体验与API调用,使得开发者能够更加轻松地接入和定制AI模型。今天,我们就来详细探讨一下蓝耘元生代推理引擎以及DeepSeek R1/V3的亮点与优势。

蓝耘元生代推理引擎的全新突破

蓝耘元生代平台致力于为开发者和企业提供最简便、最高效的AI应用构建方案。通过这一平台,用户可以轻松进行大模型调用、智能客服搭建、以及快速进行模型微调,无需编写复杂代码,就能实现定制化应用。这些功能对提高AI应用开发效率、降低门槛起到了至关重要的作用。

主要特点:

- 一站式大模型应用开发:蓝耘元生代平台提供了一个直观的界面,让开发者能够通过几行代码快速与大模型对话,进行内容创作、摘要生成等操作。

- 智能客服搭建:借助平台,用户可以高效搭建专属的AI客服,自动化处理客户咨询,减少人工干预。

- 模型微调功能:无需编程基础,用户也可以通过平台的界面化微调功能进行模型定制,使AI应用更加符合企业需求。

除此之外,蓝耘元生代平台还支持多种模型类型,除了常见的DeepSeek系列文生文模型外,还涵盖了图像、音视频的理解与生成等多模态能力,并将持续集成Llama、ChatGLM、Stable Diffusion等第三方主流模型。

DeepSeek R1/V3 满血版:性能与体验双重提升

DeepSeek系列模型自上线以来,已经获得了大量开发者和用户的喜爱。在此次推出的R1/V3满血版中,蓝耘元生代推理引擎进行了性能大幅提升,支持更高并发的API调用,带来了更快、更精确的响应速度。

关键亮点:

- 超高性能:DeepSeek R1/V3满血版采用了最新的技术架构,显著提升了推理速度和响应时间。无论是用于内容创作,还是用于复杂的数据分析,它都能提供无与伦比的效率。

- 按token计费,按小时结算:为用户提供了更加灵活的付费模式。每个API调用都按token数量计费,并且按小时整点结算。这样的计费方式能够帮助用户更精确地控制成本。

- 500万免费tokens:为支持开发者,平台为每位用户提供了500万tokens的免费额度,用户可以在不花费额外成本的情况下,尽情探索和使用模型服务。

如何快速上手?

蓝耘元生代的易用性是其另一个令人称赞的特点。即便是没有编程背景的用户,也能够通过平台提供的快速入门指南,轻松上手并实现个性化的AI应用。

快速入门步骤:

-

登录平台:首先,注册并登录蓝耘元生代智算云平台(https://maas.lanyun.net)。

体验中心:进入体验中心,用户可以轻松启动对话,立即体验DeepSeek系列模型的强大功能,下面是具体步骤。

点击进入后,进可以进行对话了

-

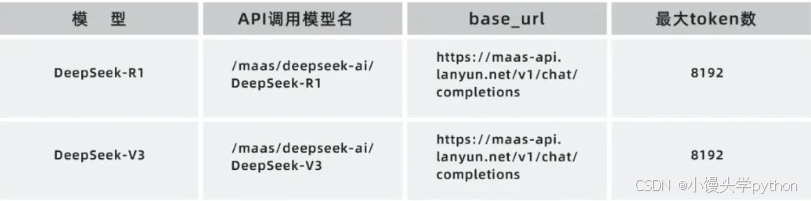

接入API:只需要获取API Key,用户就能调用相应的接口开始使用。API调用支持多种编程语言,包括Python、NodeJS和CURL,极大地提高了开发的灵活性。

官方不光提供简单的API KEY接入,此外,平台还提供了OpenAI兼容接口,开发者只需替换API URL和密钥配置,即可轻松将应用切换至DeepSeek R1/V3,保持高效、无缝的对接

第一种接入方式和大部分平台类似

第二种接入方式,官方提供了代码示例和文档介绍,还是十分用心的

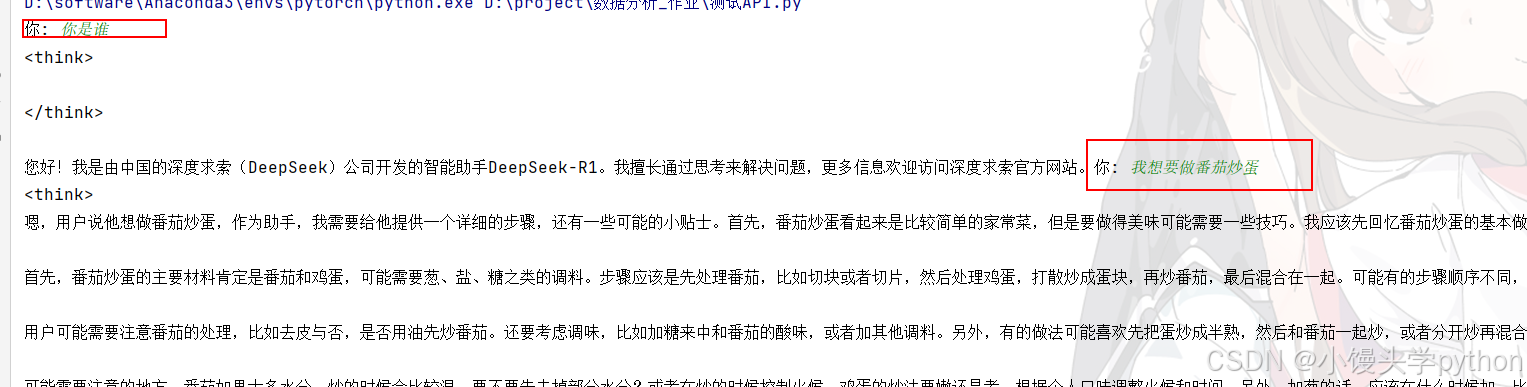

我们可以具体的测试一下,首先我们需要在创建一个.py文件,将代码和API KEY复制进去

注意:如果你没有openai的库,记得安装

pip install openai

运行后结果如下

优化代码

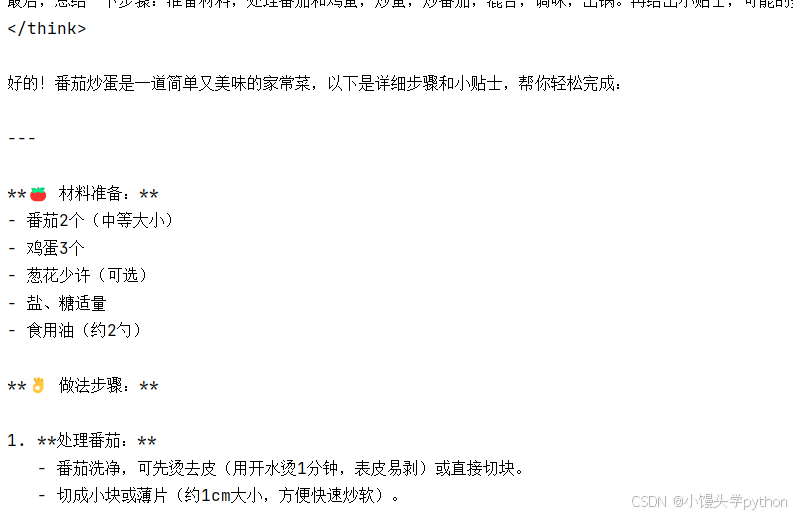

但是现在只能一问一答,我们实现一下多问多答

该说不说确实牛啊

代码附上:

from openai import OpenAI

# 构造 client

client = OpenAI(

api_key="你的API KEY", # APIKey

base_url="https://maas-api.lanyun.net/v1",

)

# 流式

stream = True

while True:

try:

# 获取用户输入

user_input = input("你: ")

# 请求

chat_completion = client.chat.completions.create(

model="/maas/deepseek-ai/DeepSeek-R1",

messages=[{

"role": "user",

"content": user_input,

}],

stream=stream,

)

if stream:

for chunk in chat_completion:

# 打印思维链内容

if hasattr(chunk.choices[0].delta, 'reasoning_content'):

print(f"{

chunk.choices[0].delta.reasoning_content}", end="")

# 打印模型最终返回的content

if hasattr(chunk.choices[0].delta, 'content'):

if chunk.choices[0].delta.content != None and len(chunk.choices[0].delta.content) != 0:

print(chunk.choices[0].delta.content, end="")

else:

result = chat_completion.choices[0].message.content

print("模型:", result)

except KeyboardInterrupt:

print("\n对话结束。")

break

资源管理与API KEY管理

蓝耘元生代平台为每位用户提供了500万免费tokens,用户可以在平台的资源包管理页面实时查询使用情况,并了解剩余额度。这对于开发者来说是一个非常有利的工具,能够帮助他们在开发过程中清晰掌握资源消耗情况,优化使用策略。

同时,API KEY的管理也非常简便。用户可以随时创建新的API Key,进行新增、查看或删除操作。强烈建议用户妥善保管自己的API密钥,避免泄露,确保应用的安全性。

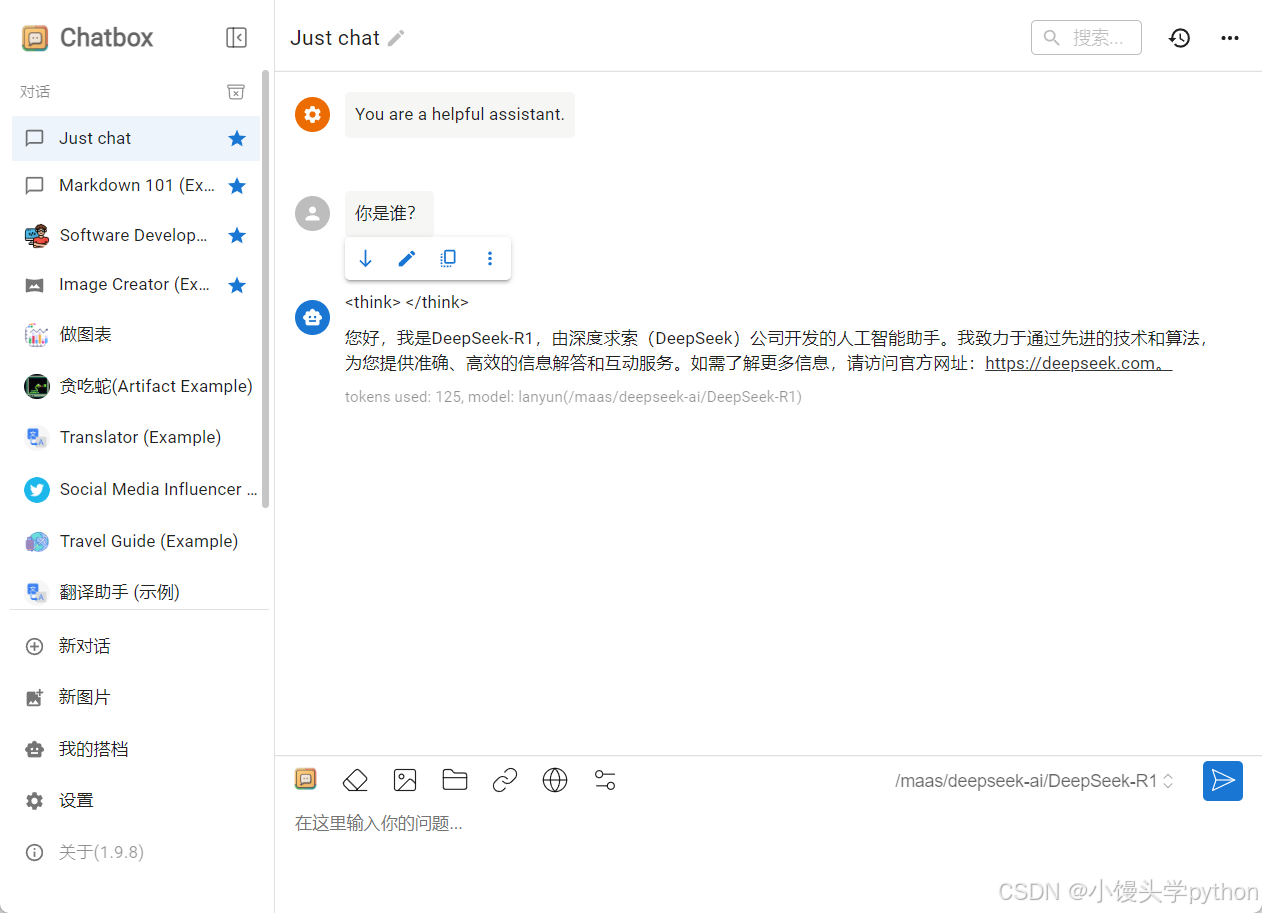

Chatbox工具的完美结合

蓝耘元生代推理引擎还与Chatbox工具实现了无缝对接。Chatbox是一款支持多个平台(Windows、Mac、iOS、Android、Web)的应用,用户只需通过Chatbox连接API Key,就能启动与DeepSeek R1/V3的对话,极大提高了交互体验。

具体步骤:

- 获取 API KEY,在API KEY管理复制出来

- 下载 Chatbox,官网戳这里https://chatboxai.app/zh,支持Win/Mac/iOS/安卓/网页版

- 配置 Chatbox,以 Windows 版为例

下面我来演示一下哈

官方给我们提供了示例:

1.名称(随便填,比如可以是 lanyun,方便区分)

2.API 地址:https://maas-api.lanyun.net

3.API 路径:/v1/chat/completions

4.API 密钥:填写刚刚复制的APIKEY

5.填写模型名称,比如/maas/deepseek-ai/DeepSeek-R1

之后我们就可以在chatbox实现对话了,还是十分简单的哈

结语

蓝耘元生代推理引擎的推出,标志着AI应用开发进入了一个新的时代。从简易的大模型调用到智能客服系统的搭建,再到模型微调的定制化操作,蓝耘元生代为开发者提供了前所未有的便利和高效。而DeepSeek R1/V3满血版则进一步提升了平台的性能,满足了不同开发者和企业用户对更高性能AI服务的需求。

如果你正在寻找一个强大且易用的AI开发平台,蓝耘元生代无疑是你不可错过的选择。立即注册,体验500万免费tokens~

本文提供了三种方式访问满血Deepseek R1/V3:蓝耘元生代平台;IDE代码实现多问多答;chatbox

最后附上注册链接:https://cloud.lanyun.net//#/registerPage?promoterCode=0131