A Spatio-Spectral Fusion Method for Hyperspectral Images Using Residual Hyper-Dense Network

IEEE Transactions on Neural Networks and Learning Systems 2024

这篇文章的研究背景是针对高光谱图像(HS)与全色图像(PAN)的空间-光谱融合问题。高光谱图像在光谱分辨率上具有优势,但空间分辨率较低,而全色图像空间分辨率较高但缺乏光谱信息。因此,通过融合这两种图像,可以提高高光谱图像的空间分辨率,从而更好地支持遥感应用[1]。

以往方法中存在的主要缺陷包括:

- 特征提取能力有限:传统方法在提取图像特征时表现不足,尤其是在处理高光谱和全色图像之间的复杂关系时[1]。

- 网络结构复杂性不足:现有深度学习模型(如DenseNets)虽然在某些任务中表现良好,但在处理空间-光谱融合问题时,未能充分利用多层次特征和跨流信息[1]。

- 梯度传递效率低:一些网络结构在训练过程中梯度传递效率较低,导致模型训练效果不佳[1]。

这篇文章提出了一种用于高光谱图像(HS)和全色图像(PAN)的时空光谱融合方法,称为残差超密集网络(RHDN)。具体研究方法如下:

- 网络结构设计:提出了一个两分支网络结构,分别处理高光谱图像在可见光范围内和范围外的特征。这种设计使得网络能够更有效地捕捉高光谱图像的特征 [1]。

- 特征提取策略:在每个分支中,采用双流策略分别处理PAN和HS图像。这种策略确保了两种不同类型的图像能够被独立处理,从而提高特征提取的准确性 [1]。

- 卷积神经网络(CNN)设计:设计了包含级联残差超密集块(RHDBs)的CNN,这些块允许同一流内部和不同流之间的层对直接连接,从而学习更复杂的HS和PAN图像之间的组合 [1]。

- 残差学习:采用了残差学习的方法,使得网络更加高效,能够更快地收敛并提高融合质量 [1]。

- 实验验证:通过大量的基准评估,验证了所提出的RHDN融合方法在多个广泛接受的最新方法上具有显著的优势 [1]。

通过这些方法,作者成功提出了一种高效且高精度的时空光谱融合方法,显著提升了融合图像的空间分辨率 [1]。

A.建议的RHDB结构

一般来说,网络越深,泛域性能越好。然而,大多数基于CNN的深层架构都会导致梯度消失问题。为了解决这个问题,[33]中的研究开发了一种新的残差密集网络(RDN),以充分利用所有卷积层的分层特征。RDN建立在从残差密集块(RDB)的卷积层添加到所有后续层的直接访问以及从一个RDB添加到下一个RDBMS的每一层的直接连接的思想之上。

RDB设计密集连接的卷积层来提取丰富的局部特征[图1(a)]。RDN结构特别适合解决超分辨率问题,原因如下:1)它通过充分利用局部和全局特征实现了深度监控,2)所有层之间的密集连接有助于解决梯度消失问题。受RDB在超分辨率任务中的成功启发,人们提出了许多特征提取块[46]-[51]。

为了提高网络收敛速度,提出了一种具有深度RDB的深度残差密集网络(DRDN)[图1(d)],该网络从浅层特征引入了多跳连接[46]。在密集块的基础上,设计了剩余密集旁路块[图1(c)],该旁路块将密集连接块与旁路剩余块相结合[47]。Li等人[49]设计了一种多尺度残差块(MSRB)[图1(b)],该块采用不同大小的卷积核来检测不同尺度的特征,并在不同尺度特征之间应用跳跃连接。同样,提出了一种用于图像超分辨率的多尺度RDN,该RDN使用多个尺度来提取特征,并采用扩展卷积来增加感受野的面积[50]。分层密集块(HDB)旨在在不同阶段充分利用多尺度特征表示[51]。

上述特征提取块是为图像超分辨率任务而设计的。HS图像超分辨率任务只有一个输入HS图像,超分辨率网络仅从HS图像中提取特征。HS和PAN图像的空间光谱融合处理不仅有一个输入HS图像,还有一个输入PAN图像。对于HS泛扫任务,现有的方法直接级联PAN和HS图像,然后使用特征提取块提取特征并重建HS图像,这不利于提取PAN图像的空间信息。为了解决这一缺点,我们提出了一种用于HS pansharpening的RHDB,它扩展了HS和PAN特征提取流内部和之间的低级和高级特征之间的密集连接。

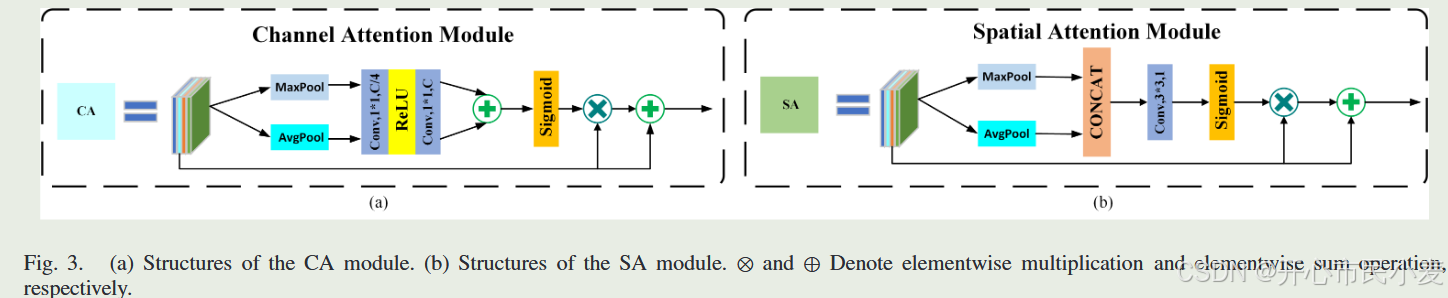

与CA模块不同的是,SA模块注重泛色法中有利于空间细节增强的信息区域。CA和SA模块改善了两个流的所有级别之间的信息流和梯度,从而提高了学习表示的有效性。RHDB以前馈方式连接两个流的所有前一层的所有特征输出。密集的连接发生在两个流的所有层内和层之间。与仅从自身流中提取特征的双流块(TSB)相比,RHDB不仅充分利用了自身流中的层次特征,还充分利用了不同流中的互补特征。因此,RHDB通过探索流内和流间层之间的层次特征,展示了更强大的特征表示。

B.Baseline

在本研究中,考虑了一个基线(如图4所示)。它由四个子网络组成:1)浅层特征提取(SFEN);2) 深度特征提取(DFEN);3) FFN;以及4)细节重建(DRN)。PAN图像的空间和光谱特性与HS图像明显不同。PAN图像通常以空间细节为特征。HS图像显示出丰富的光谱信息,但空间内容有限。因此,我们开发了一种新的双流特征提取子网络来学习PAN图像和HS图像的浅层特征表示。SFEN是一个DFEN,用于提取深层特征。这些深层特征被馈送到FFN进行特征融合。根据泛搜索的一般思想,提取的细节应通过DRN重建并注入插值的HS图像中以生成HR-HS图像。

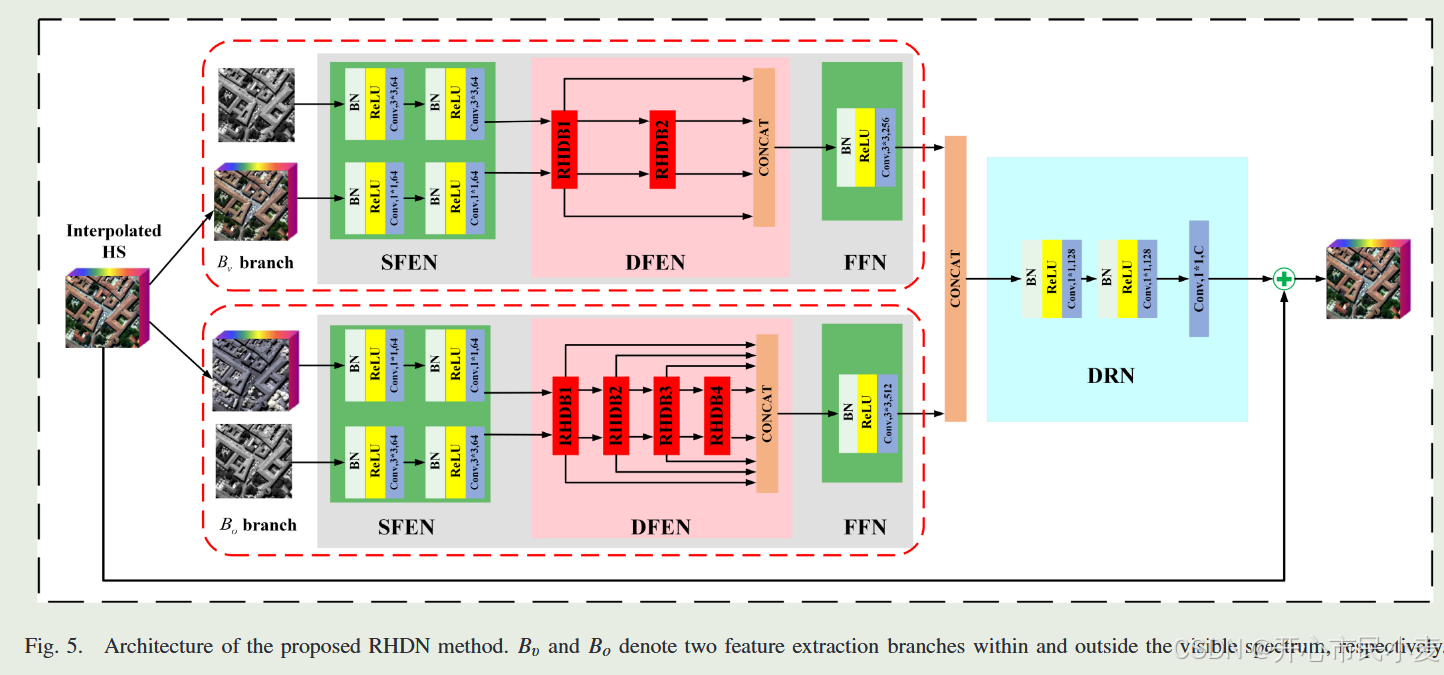

在第一节挑战的描述中,已经表明,当PAN图像仅覆盖可见光谱,HS图像不仅覆盖可见光谱而且覆盖SWIR光谱范围时,可见光谱外范围内缺失的空间信息更难估计。换句话说,预计应分别估计HS图像在可见光谱范围内和PAN图像未覆盖的光谱范围内的缺失空间细节。因此,在所提出的RHDN pansharpening方法中,设计了两个特征提取分支来估计可见光谱内外缺失的空间细节。每个分支包含两个流,用于提取HS和PAN图像的特征。我们提出的RHDN模型保持了基线的高级结构设计(见图4),并包含两个特征提取分支,如图5所示。实验结果表明,与基线相比,所提出的RHDN模型在空间增强和光谱保真度方面具有优势。

C.拟议RHDN的网络结构

图5显示了拟议RHDN方法的架构,该方法由四个主要步骤组成:SFEN、DFEN、FFN和DRN。

RHDN的整体结构包含四个主要步骤:

- 浅层特征提取(Shallow Feature Extraction, SFEN)

- 深层特征提取(Deep Feature Extraction, DFEN)

- 密集特征融合网络(Dense Feature Fusion Network, FFN)

- 细节重建(Detail Reconstruction, DRN)

1) 浅层特征提取:所提出的RHDN方法包含一个具有深层结构的双分支网络,可以分别捕获可见光谱范围内外的HS图像的特征。在每个分支,我们采用双流特征提取子网络来提取PAN和HS图像的细节。通过计算可见光谱范围内的子带来获得可见分支中HS流的输入,记为Hv。可见分支Bv的HS流以SFEN开始,其中堆叠了N个卷积块以提取浅特征表示

PAN SFEN流保持与HS特征提取流类似的结构。考虑到相邻像素,它与HS SFEN流的像素有很大不同。在PAN-SFEN步骤中,使用具有3×3卷积核的两个卷积块,以使用更大的感受野充分利用相邻像素的空间信息。

- HS流:使用1×1卷积核提取HS图像的光谱特征。

- PAN流:使用3×3卷积核提取PAN图像的空间信息,充分利用相邻像素的空间信息[6][7]。

2) 深度特征提取:DFEN子网络主要由RHDB组成,它允许同一流中的层对和不同流之间的层对直接连接。SFEN子网络的两个流的特征被馈送到这个后续的DFEN子网络中。假设Bv分支的DFEN由L个RHDB组成。

DFEN子网络由多个残差超密集块(Residual Hyper-Dense Block, RHDB)组成。RHDB允许在同一流内和不同流之间建立直接连接,充分利用来自PAN和HS图像的多层次特征。具体表现为:

- 密集连接:RHDB通过在不同的流之间建立密集连接,增强了特征的表示能力[8]。

- 通道注意力(CA)和空间注意力(SA)模块:分别用于增强HS和PAN图像的特征表示,CA模块关注通道间的关系,SA模块关注空间细节[9]。

3) 密集FFN:当使用一组RHDB提取分层特征时,会进行密集FFN以融合从前一层提取的特征。FFN遵循级联,由一个卷积块组成(见图5)。

4) 细节重建:Bo保持了与Bv相似的结构。正如我们前面提到的,定义泛锐化模型的困难在于如何在PAN图像未覆盖的光谱范围内产生良好的性能。因此,关于Bo的DFEN子网,它与Bv的子网有很大的不同。Bo的DFEN含有比Bv更多的RHDB。然后将两个子网络Fv,D和Fo,D的特征沿着光谱维度连接起来,并馈入以下DRN子网络,其中堆叠两个卷积块以提高表示能力,并采用一个卷积层来重建细节图。

5) 细节重建(DRN):DRN通过卷积块和残差块的堆叠,重建细节图。最终的高分辨率HS图像通过将重建的细节注入到插值后的HS图像中生成[11]。

6)损失函数

RHDN使用L1损失函数来训练网络,目标是最小化重建HS图像与参考HS图像之间的残差误差[12]。

7)高分辨率HS图像重建

通过训练RHDN网络,估计HS图像的缺失细节,并最终生成高分辨率HS图像[13]。

实验:

1. 数据集与实验设置

实验使用了三个公开的高光谱数据集:Pavia Center、Houston和Botswana。每个数据集的处理步骤包括:

从参考高光谱图像生成模拟的低分辨率高光谱图像(LR-HS)和高分辨率全色图像(HR-PAN),使用Wald协议进行降采样和模糊处理 [53]。

将图像分割为多个不重叠的 patch,并进一步划分为更小的 patch 以增加训练样本数量 [1]。

2. 对比方法与质量评估

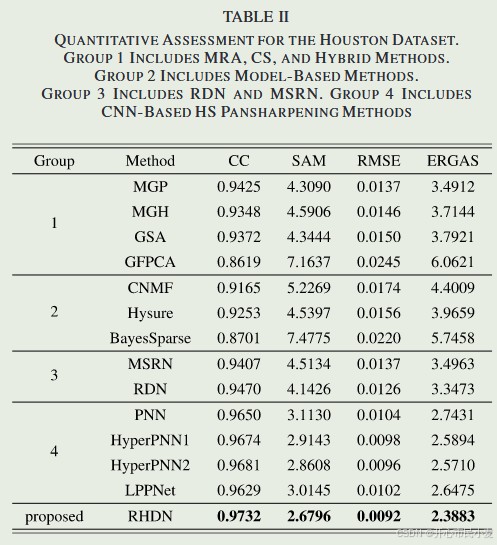

论文将提出的 RHDN 方法与七种经典的高光谱图像融合方法和六种基于卷积神经网络(CNN)的先进方法进行了对比。经典方法包括 GSA、GFPCA、MTF-GLP、MTF-GLP-HPM、CNMF、Hysure 和 BayesSparse;CNN 方法包括 PNN、HyperPNN1、HyperPNN2、LPPNet、MSRN 和 RDN。评估指标包括光谱角映射(SAM)、交叉相关(CC)、均方根误差(RMSE)和全局相对误差(ERGAS)[55][56]。

3. 实验结果与分析

实验结果表明,RHDN 在所有数据集上均表现出优异的性能,特别是在空间增强和光谱保真度方面:

Houston数据集:RHDN 在视觉对比和定量指标(如 SAM、CC、RMSE 和 ERGAS)上均优于其他方法,尤其是在空间细节的保留和光谱信息的恢复方面 [1]。

Pavia Center数据集:RHDN 在视觉和定量评估中均表现出色,特别是在光谱保真度方面,显著优于其他经典和基于 CNN 的方法 [1]。

Botswana数据集:RHDN 在处理光谱范围外的缺失空间细节时表现出色,进一步验证了其在复杂场景下的鲁棒性 [1]。

4. 消融研究

为了验证 RHDN 中不同组件的有效性,论文进行了多项消融实验:

RHDB数量对性能的影响:实验表明,随着 RHDB 数量的增加,网络性能逐渐提升,但当 RHDB 数量过多时,性能提升有限。最终选择在每个分支中使用不同数量的 RHDB 以达到最佳性能[1]。

RHDB与其他特征提取块的对比:相比于仅从单一流中提取特征的块,RHDB 通过在不同流之间建立连接,显著提升了特征表示能力 [1]。

基线模型与 RHDN 的对比:RHDN 使用两个独立的特征提取分支来处理可见光谱范围内外的高光谱图像,相较于基线模型,在光谱范围外的细节估计上表现更优 [1]。

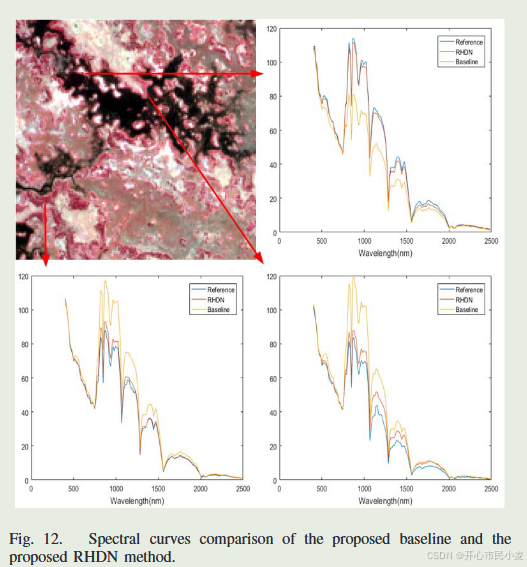

基线和RHDN的光谱曲线比较:本文提出的基线(如图4所示)利用一个特征提取分支同时学习PAN和HS图像的特征。在所提出的RHDN方法中(如图5所示),设计了两个特征提取分支,用于捕获可见光谱内外HS图像的特征,并从PAN图像中估计可见光谱内外缺失的空间细节。为了验证所提出的RHDN方法的有效性,我们比较了RHDN和基线获得的融合结果的光谱曲线。图12显示了从博茨瓦纳数据集中随机选择的三个像素的光谱曲线的比较结果。从图12中可以看出,拟议基线和拟议RHDN在可见光谱(400-760nm)中的光谱曲线与参考图像的光谱曲线非常相似。然而,在SWIR光谱范围内(可见光谱外),参考光谱曲线与RHDN生成的光谱曲线之间的差异远小于参考光谱曲线和基线生成的光谱线之间的差异。这证明了所提出的RHDN方法利用两个单独的分支来提取可见光谱内外的特征,可以更有效地估计缺失的细节信息,并产生更好的融合性能。

5. 计算时间

与 CNN 方法相比,RHDN 需要更多的计算时间,但其在稳定性和收敛性方面表现良好,且其计算时间在可接受范围内 [1]。

6. 结论

实验结果表明,RHDN 在空间增强和光谱保真度方面均优于现有的经典和基于 CNN 的方法。未来的研究方向包括将点扩散函数(PSF)引入深度学习模型中 [1]。

通过上述实验,论文验证了 RHDN 在高光谱图像融合任务中的有效性,并展示了其在处理复杂场景下的优越性能。