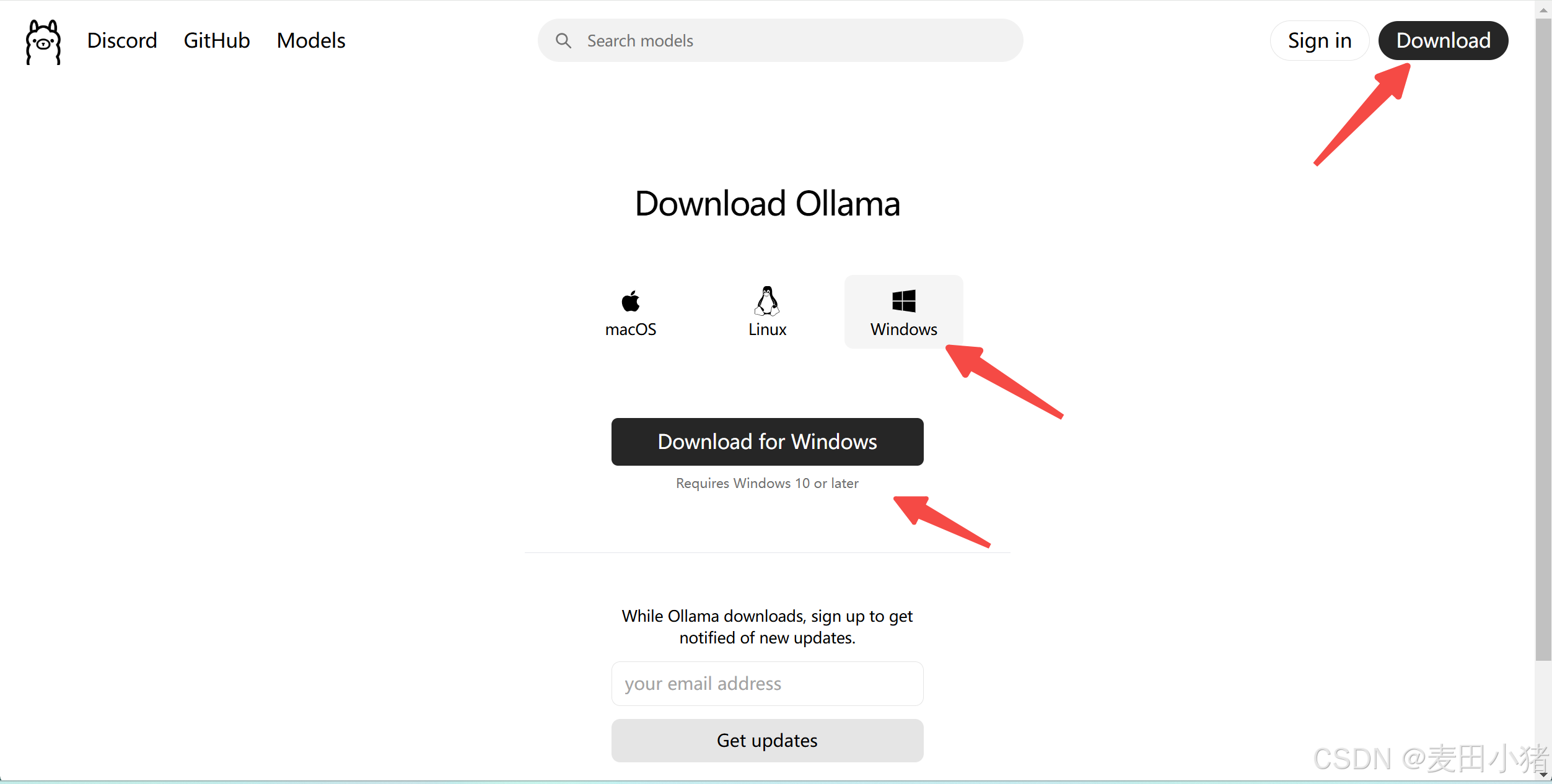

下载ollama:Download Ollama on macOS

若无法下载可以使用百度云盘:链接:https://pan.baidu.com/s/131jI2btGiZgOksv5neIacA?pwd=568a

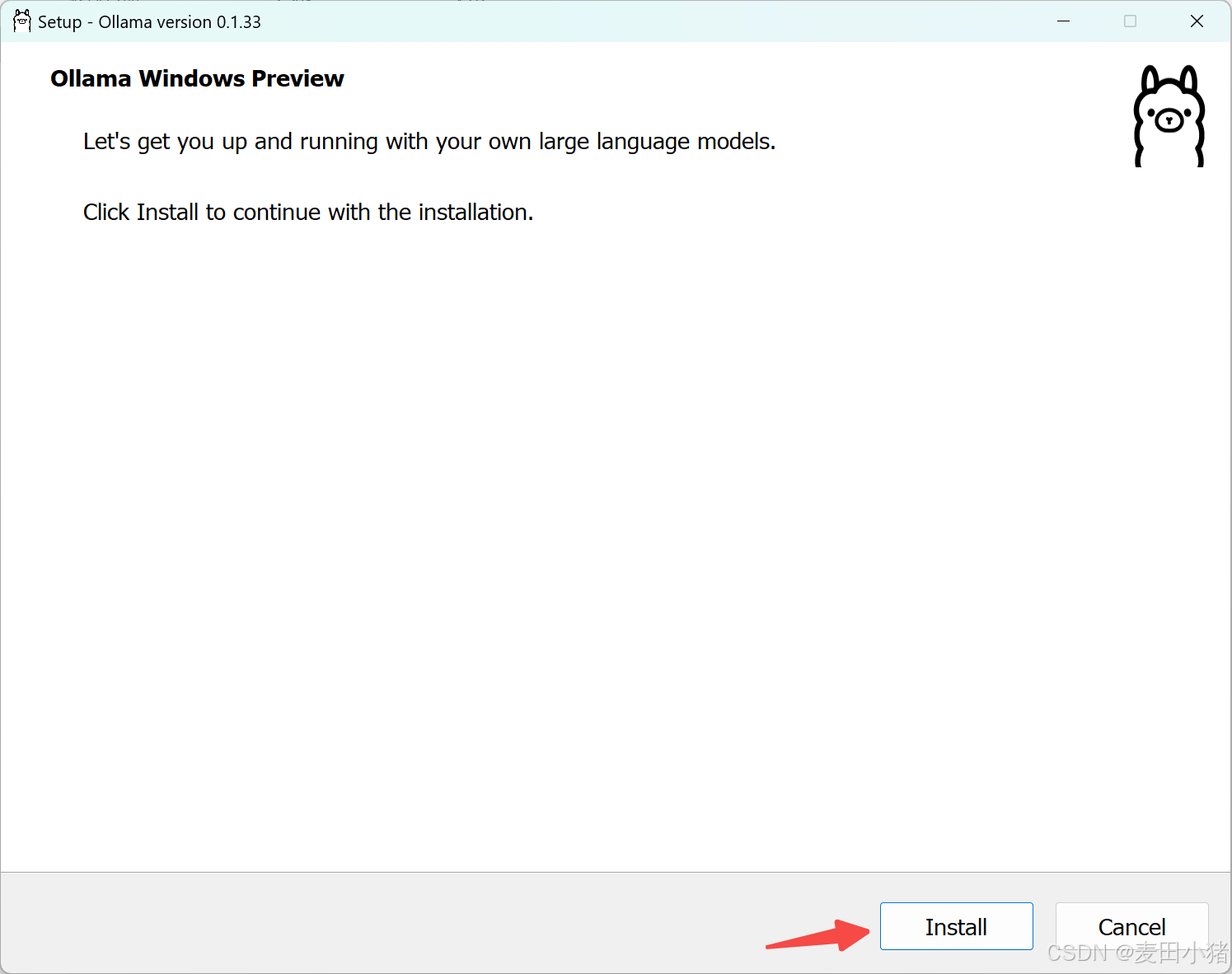

直接双击运行ollama.exe

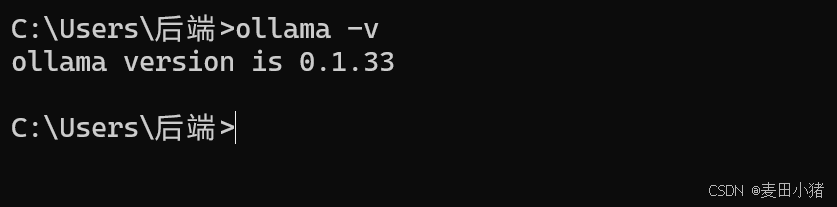

打开cmd,运行ollama -v

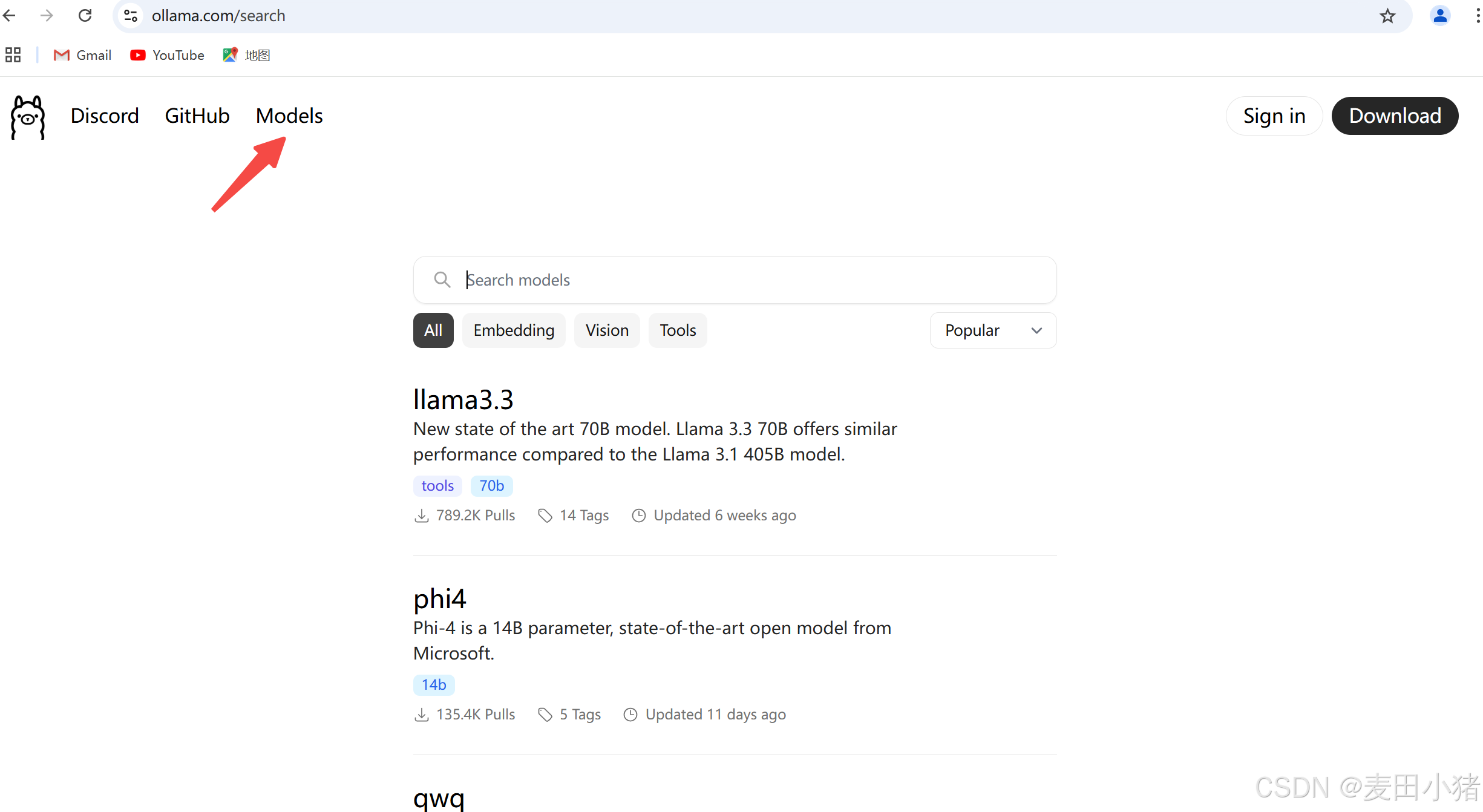

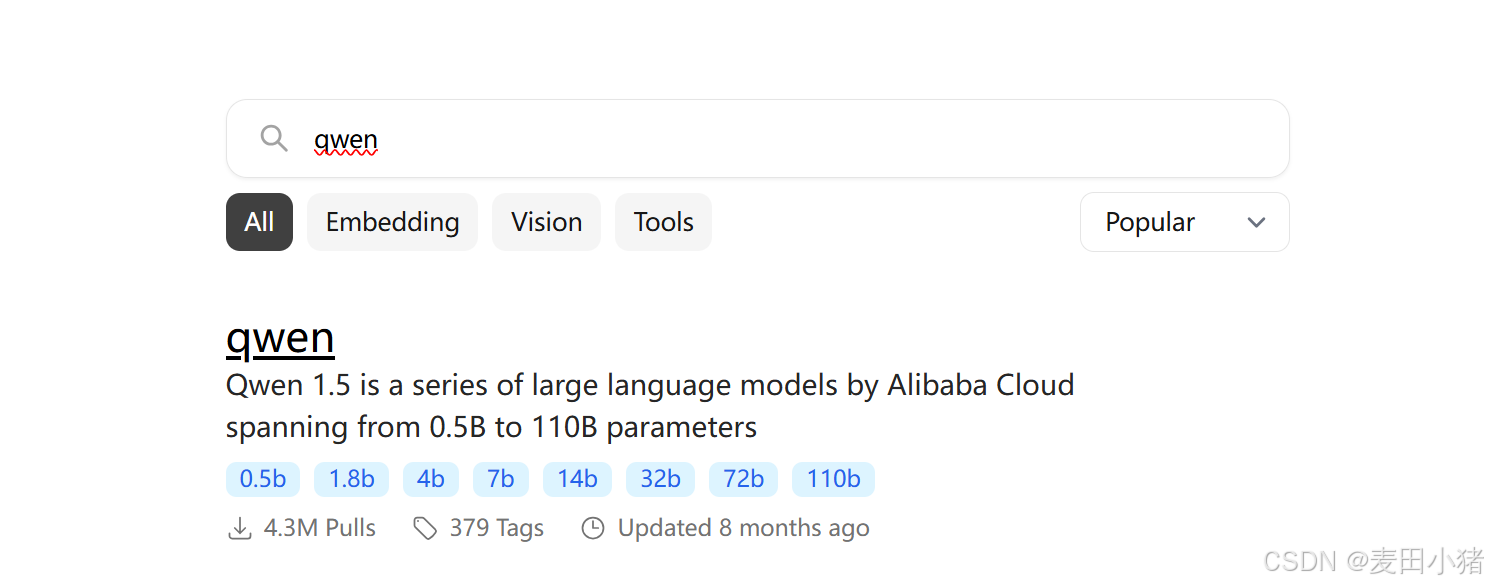

在ollama官网可以查看可用的models

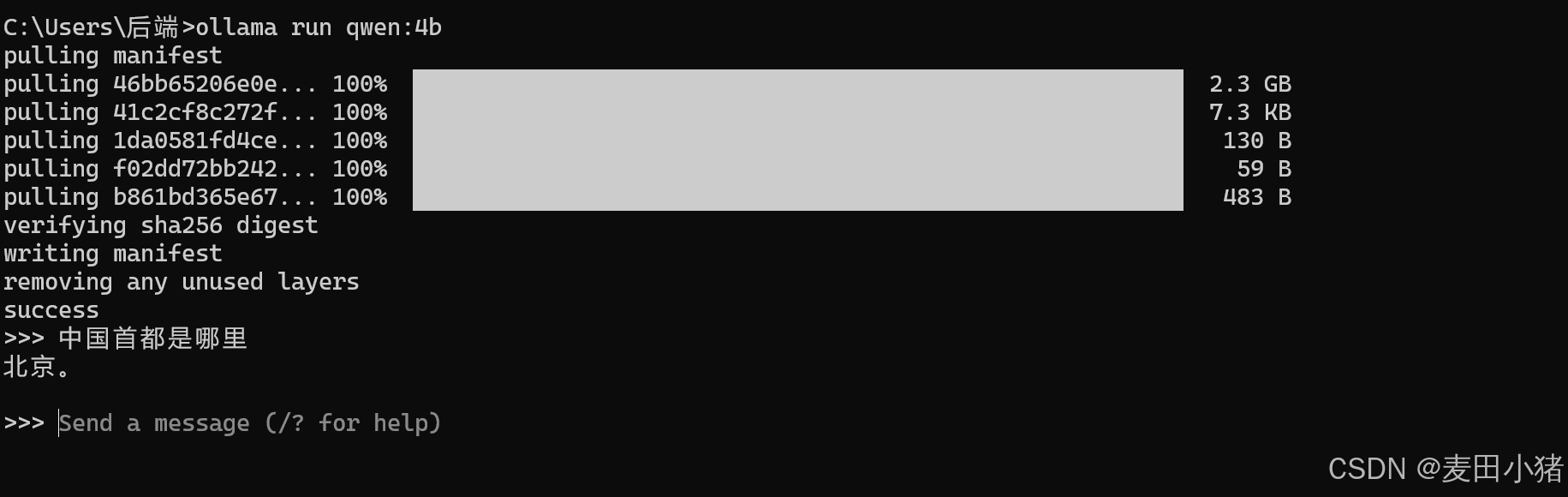

根据自己需求选择对应的模型来下载安装,如想在本地安装qwen大模型

左边为模型的版本,b越大表示模型训练的数据量越大,搜索结果越精确,但是需要的gpu/cpu资源越大,大家可以根据自己的硬件,需求来选择。右边是下载命令,直接copy后在cmd中运行即可。

至此安装成功

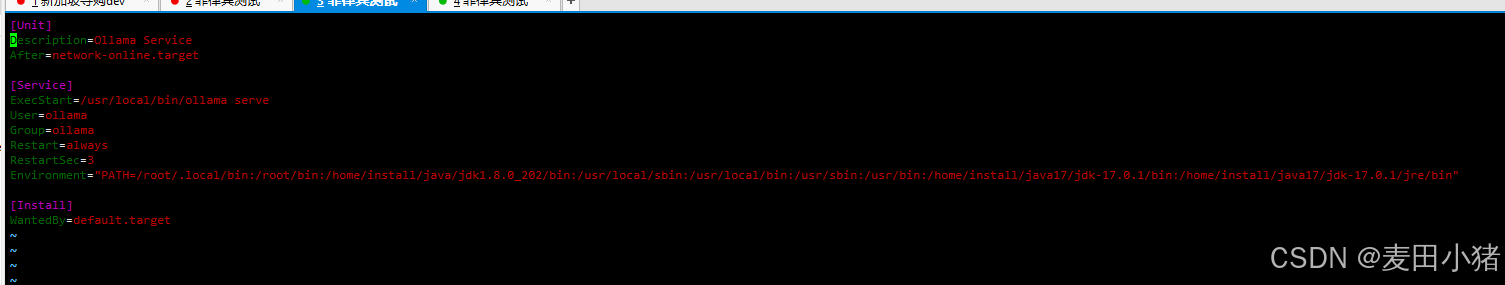

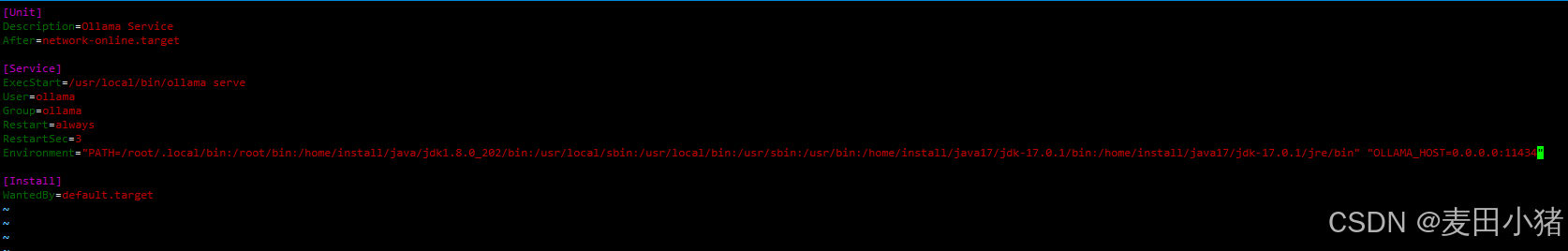

注意在阿里云上装ollama时需要修改一下配置,不然使用ip将无法访问

修改:vi /etc/systemd/system/ollama.service

原配置:

修改后配置:

ollama常见命令:

ollama list 列出所有模型

ollama ps 列出正在运行的模型

ollma rm 删除模型