前言

在 AI 发展浪潮中,逻辑推理能力正成为衡量智能水平的重要标准。而DeepSeek-R1 作为一款由中国 AI 公司 DeepSeek 开发的开源推理模型,正引领这一领域的新变革。它不仅能解决复杂的数学问题,还能执行实时决策,为 AI 在实际应用中的落地提供了更多可能性。

在本教程中,我将手把手带你完成 DeepSeek-R1 在本地的运行流程,并详细讲解如何使用 Ollama 进行环境配置。

此外,我们还将探索如何结合 R1 模型、LangChain 和 Gradio,从零搭建一个轻量级的 RAG 应用,让你的笔记本电脑秒变智能问答助手!无论你是刚接触 RAG 还是想要在本地体验最新的大模型技术,这篇教程都将为你提供清晰易懂的实践指南。

在本地运行 DeepSeek-R1 带来了诸多优势,尤其是对于希望享有更多控制权的用户。以下是一些显著的好处:

-

隐私和安全:所有数据都保留在您的系统内,无需担心数据外泄。

-

不间断访问:避免了因速率限制、停机或服务中断而带来的使用困扰。

-

性能:通过本地推理,您可以获得更快的响应速度,避免了 API 延迟带来的影响。

-

自定义:您可以根据需求修改参数、微调提示,甚至将模型整合到本地应用中,提升灵活性。

-

成本效益:在本地运行模型无需支付 API 费用,节省了开销。

-

离线可用性:一旦下载模型,即可在没有互联网连接的情况下继续工作,确保随时随地可用。

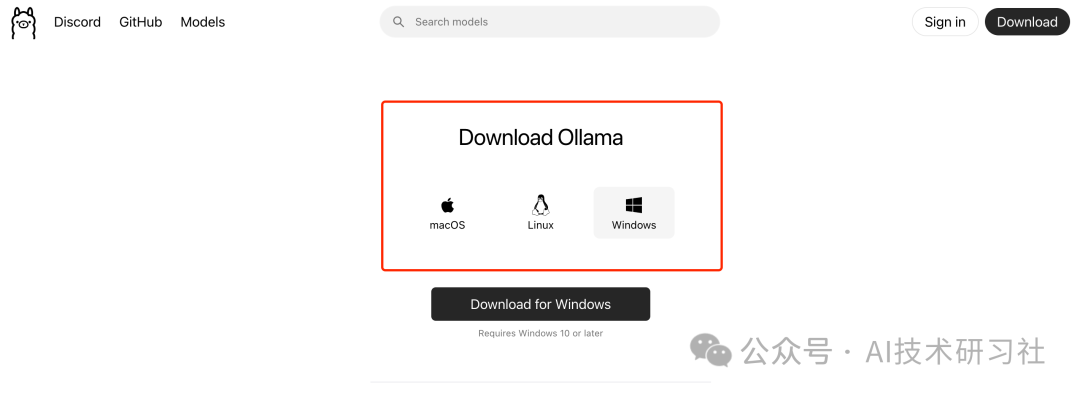

Ollama 是一个开源平台,旨在简化和加速本地 AI 模型的部署和管理。它提供了一个简单的界面,使开发者能够轻松地在本地运行和配置多个 AI 模型,尤其适用于大语言模型(LLMs)。

Ollama 支持快速启动模型,并优化推理性能,允许用户在不依赖外部服务器的情况下进行高效的 AI 操作。它为开发者提供了灵活的环境,可以方便地进行模型集成、定制和性能调优。

下载完成后,您可以像安装任何其他应用程序一样,安装 Ollama 应用程序。安装成功后,接下来我们需要测试环境设置并下载模型。请按照以下步骤操作:

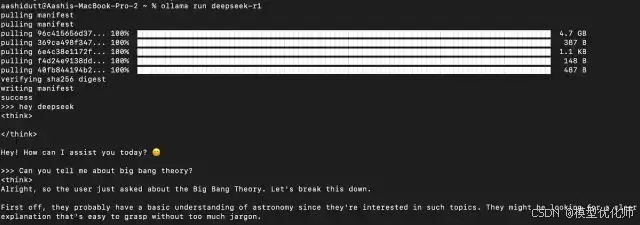

ollama run deepseek-r1

此命令将启动 DeepSeek-R1 模型的下载过程,并在本地环境中运行它。完成后,您就可以开始与模型进行交互,测试其性能和功能。

Ollama 提供一系列 DeepSeek R1 模型,从 1.5B 参数到完整的 671B 参数模型。671B 模型是原始的 DeepSeek-R1,而较小的模型是基于 Qwen 和 Llama 架构的提炼版本。

如果您的硬件不支持 671B 型号,您可以使用以下命令并将下面的 X 替换为您想要的参数大小(1.5b、7b、8b、14b、32b、70b、671b),轻松运行较小的版本:

ollama run deepseek-r1:Xb

为了让 DeepSeek-R1 持续运行并通过 API 提供服务,您需要启动 Ollama 服务器。在终端中执行以下命令:

ollama serve

该命令将启动 Ollama 服务器,使 DeepSeek-R1 在后台持续运行,并通过 API 提供访问。完成后,您就可以通过 API 调用与模型进行交互了。

下载并安装 DeepSeek-R1 模型后,您可以直接在终端中与模型进行交互。只需启动终端,并运行以下命令:

ollama chat DeepSeek-R1

这将启动一个交互式会话,您可以直接向 DeepSeek-R1 提出问题或请求,模型会实时返回答案或响应。您无需依赖外部服务,完全在本地进行交互,享受更快的响应速度和更高的控制性。

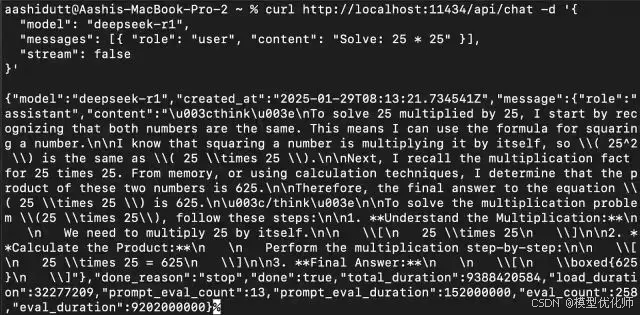

要将 DeepSeek-R1 集成到您的应用程序中,您可以使用 curl 通过 Ollama API 与模型进行交互。以下是如何使用 curl 调用 Ollama API 并与 DeepSeek-R1 进行集成的示例:

curl http://localhost:11434/api/chat -d '{

"model": "deepseek-r1",

"messages": [{

"role": "user", "content": "Solve: 25 * 25" }],

"stream": false

}'

在这个命令中:

-

localhost:11434 是本地 Ollama 服务器的默认地址和端口。

-

"model": "DeepSeek-R1"指定了您希望使用的模型。 -

"question": "Your question here"是您希望模型回答的问题,您可以根据需求替换为实际的问题内容。

通过这种方式,您可以将 DeepSeek-R1 集成到任何支持 HTTP 请求的应用程序中。

curl 是 Linux 原生的命令行工具,但也适用于 macOS。它允许用户直接从终端发出 HTTP 请求,使其成为与 API 交互的绝佳工具。

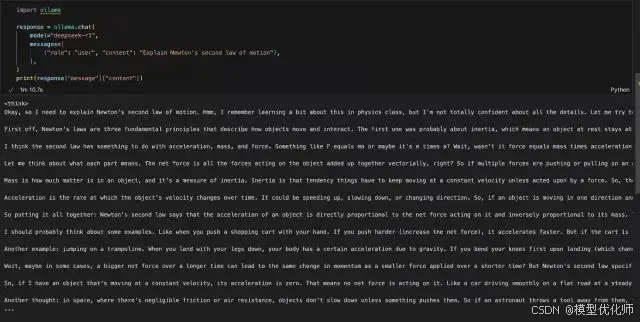

我们可以在选择的任何集成开发环境 (IDE) 中运行 Ollama。您可以使用以下代码安装 Ollama Python 包:

!pip install ollama

安装 Ollama 后,使用以下脚本与模型交互:

import ollama

response = ollama.chat(

model="deepseek-r1",

messages=[

{

"role": "user", "content": "Explain Newton's second law of motion"},

],

)

print(response["message"]["content"])

ollama.chat() 函数获取模型名称和用户提示,并将其作为对话交换进行处理。然后,该脚本提取并打印模型的响应。

使用 Ollama 在本地运行 DeepSeek-R1 可以实现更快、更私有且经济高效的模型推理。通过简单的安装过程、CLI 交互、API 支持和 Python 集成,您可以将 DeepSeek-R1 用于各种 AI 应用程序,从一般查询到基于检索的复杂任务。

接着分享一个重磅新闻!ai.com域名作为一个具有30年历史的顶级域名,一直是人工智能领域的一个标志性地址。过去,这个域名经历了多次易主,每次都吸引了大量关注。

而如今,这个域名的重定向到 DeepSeek 官网,标志着它在人工智能领域的最新演变。

ai.com 作为一个具有巨大潜力的域名,在 ChatGPT 爆火后被 OpenAI 以至少1100万美元的价格收购,成为历史上最贵的域名之一,这无疑凸显了人工智能行业的商业价值。

如今,它的重定向转移到 DeepSeek 官网,更是给人一种新旧交替、技术迭代的强烈感觉。这个域名背后的商业故事以及它的潜在价值,绝对是值得关注和讨论的焦点!

最后的最后

感谢你们的阅读和喜欢,作为一位在一线互联网行业奋斗多年的老兵,我深知在这个瞬息万变的技术领域中,持续学习和进步的重要性。

为了帮助更多热爱技术、渴望成长的朋友,我特别整理了一份涵盖大模型领域的宝贵资料集。

这些资料不仅是我多年积累的心血结晶,也是我在行业一线实战经验的总结。

这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。如果你愿意花时间沉下心来学习,相信它们一定能为你提供实质性的帮助。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】