随着大型语言模型(LLM)在智能客服、内容创作、代码生成等领域的广泛应用,推理框架作为高效部署的核心组件,直接决定了应用的性能、成本和开发效率。本文将结合当前主流推理框架的特点和应用场景,为您提供一份专业的选型指南。

一、高性能推理框架选型

1. vLLM

- 核心优势:采用PagedAttention技术,突破传统KV缓存机制,支持超长序列生成(如10万token对话),吞吐量在A100 GPU上可达传统框架3倍以上,支持动态批处理,原生支持HuggingFace模型格式,兼容PyTorch生态。

- 适用场景:互联网大厂API服务、高并发在线推理(1000+ QPS)、长文本生成场景(如法律文书生成、代码补全)。

2. LMDeploy

- 技术亮点:采用Turbomind引擎,异步流水线并行,延迟降低至50ms级别;支持W4A16量化,模型体积压缩4倍;动态批处理,GPU利用率达90%+。

- 典型应用:金融实时风控系统、游戏NPC智能对话、工业质检实时报告生成。

3. TGI (Text Generation Inference)

- 企业级特性:内置健康检查、自动故障转移,支持多GPU扩展(Tensor并行和流水线并行),符合GDPR和HIPAA标准。

- 部署案例:AWS SageMaker推理服务、银行智能客服系统、医疗报告自动生成平台。

4. SGLang

- 架构创新:RadixAttention构建注意力计算树,复用中间结果;支持跨节点自动负载均衡,混合精度计算(FP16与FP32智能切换)。

- 适用领域:多模态模型推理(文本+图像)、复杂工作流编排(RAG增强生成)、科研机构超大规模模型实验。

5. DeepSeek AI Open Infra Index

- 底层优化套件:基于CUDA的矩阵运算加速库(FlashMLA),弹性并行框架(DeepEP),自适应数据预取策略。

- 协同生态:与vLLM结合提升显存利用率40%,与SGLang集成优化分布式任务调度。

二、本地部署与轻量化框架对比

| 框架 | 核心特性 | 硬件要求 | 典型应用场景 |

|---|---|---|---|

| Ollama | 一键部署/Web界面 | 消费级GPU(6GB+) | 个人知识管理/快速原型验证 |

| Llama.cpp | GGUF格式支持/纯CPU推理 | 树莓派4B | 工业边缘设备/隐私计算盒子 |

| LocalAI | 本地化数据隔离/端到端加密 | 服务器CPU集群 | 政务系统/医疗数据解析 |

| KTransformers | 能效比优化(<5W) | ARM架构芯片 | 物联网设备/车载语音助手 |

| GPT4ALL | 图形化模型市场/零代码部署 | Mac M系列芯片 | 教育机构/非技术用户实验 |

三、灵活部署框架选型策略

1. XInference

- 核心能力:多模型并行服务(同时加载10+模型),动态扩缩容,100% OpenAI API协议支持。

- 推荐场景:中小型企业多模型服务中台、科研机构对比实验平台。

2. OpenLLM

- 技术优势:异构硬件支持(TPU/GPU/CPU混合部署),自定义适配器(LoRA插件热加载),服务监控(Prometheus集成)。

- 典型用户:云服务提供商(混合云部署)、自动驾驶模型服务集群。

3. Hugging Face Transformers

- 生态优势:支持模型数量200,000+,社区贡献机制(日均更新50+模型),支持Triton/ONNX Runtime部署。

- 首选场景:学术研究快速实验、创业公司MVP开发。

4. LiteLLM

- 统一接口方案:支持30+主流LLM,智能路由与负载均衡,按token计费分析。

- 适用对象:多模型SaaS平台、企业混合云成本优化。

四、开发者友好型框架深度解析

1. FastAPI

- 技术栈组合:FastAPI + Uvicorn + vLLM → 容器化部署 → Kubernetes集群。

- 性能指标:单节点QPS 1200+(A10 GPU),延迟<200ms(P99)。

2. Dify

- 可视化开发流:零代码编排(拖拽式RAG管道构建)、版本管理(模型快照与回滚)、A/B测试(流量分桶对比)。

3. Coze(扣子)

- 全链路支持:浏览器IDE + 调试工具、微信/飞书插件一键发布、用户行为分析看板。

- 创新特性:自然语言编程(用prompt定义业务逻辑)、知识库自动同步(GitHub/Wiki实时连接)。

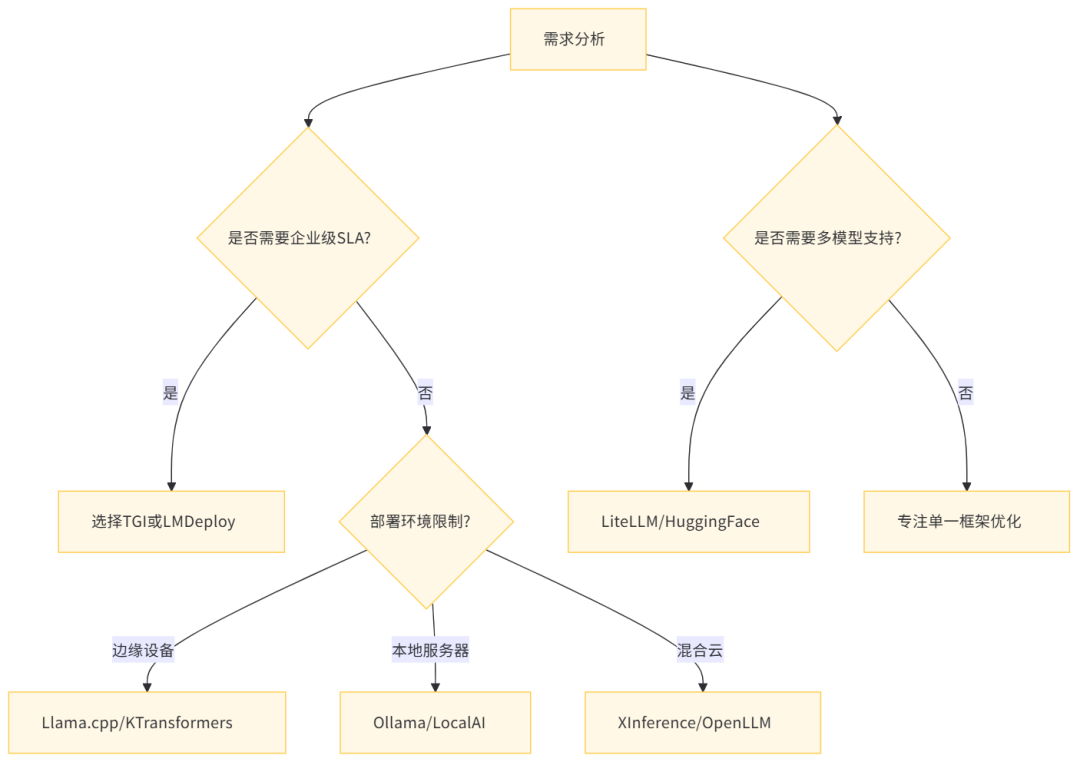

五、选型决策树

六、性能基准测试数据

| 框架 | 吞吐量 (tokens/s) | 显存占用 (GB) | 启动时间 (s) |

|---|---|---|---|

| vLLM | 2450 | 18.7 | 4.2 |

| TGI | 1820 | 22.1 | 5.8 |

| LMDeploy | 2100 | 15.3 | 3.9 |

| Ollama | 850 | 6.2 | 1.1 |

测试环境:单卡A100-80G,LLaMA2-13B模型,输入长度512,输出长度256

七、场景化选型建议

7.1 资源有限的本地环境选型

在资源有限的本地环境中,如个人电脑或边缘设备,选择合适的 LLM 推理框架至关重要。这类场景通常对硬件资源的需求较低,更注重部署的简便性和模型的轻量化。

- Ollama 是一个极佳的选择。它提供了一键加载模型的极简本地部署方案,集成了用户友好的 Web 界面,支持 Windows、macOS 与 Linux 平台。Ollama 内置超过 1700 款预训练模型,并默认提供 int4 量化处理后的权重,大幅降低了显存需求,使普通消费级硬件也能流畅运行。例如,在个人用户的本地实验中,Ollama 可以在短时间内完成模型加载和部署,极大地提高了开发效率。

- Llama.cpp 也是一个不错的选择。它专注于 CPU 优化设计,以轻量级著称,资源占用极低,完美适用于边缘设备和资源受限的特殊环境。它基于 C++ 编写,支持多种量化和优化技术,可以在 CPU 上高效运行 Llama 等模型。在实际应用中,Llama.cpp 能够在边缘设备上快速启动和运行,为用户提供实时的推理服务。

- LocalAI 专注于在本地运行 LLM,将数据隐私和安全性置于首位,尤其适合对数据敏感度有极高要求的应用场景。它支持 CPU 和 GPU 推理,能够满足不同用户的需求。例如,在一些对数据隐私要求极高的企业场景中,LocalAI 可以确保数据在本地安全运行,同时提供高效的推理性能。

7.2 高性能推理需求选型

对于高性能推理需求的场景,如企业级应用、实时对话系统、大规模内容生成平台等,选择能够提供极致性能的推理框架是关键。

- vLLM 是高性能 GPU 推理的领军者。它通过创新的 PagedAttention 技术和 Continuous Batching 技术,极大地提升了 GPU 的利用率和吞吐量。vLLM 的推理速度比传统框架快数倍,能够显著降低推理延迟。例如,在某金融企业的风险评估系统中,vLLM 的推理速度比传统框架快了 4 倍,极大地提高了系统的响应速度和处理效率。此外,vLLM 还支持多种量化方法,如 FP8 等,进一步优化了模型的性能和资源占用。

- LMDeploy 以极致的 GPU 性能为目标,通过深度优化底层算子和调度策略,实现了超低的推理延迟和极高的吞吐量。它还深度应用了 FlashAttention 技术,进一步提升了性能。LMDeploy 特别注重对国产 GPU 的适配,使其在国产 GPU 上的性能表现与国际主流 GPU 相当。例如,在某智能安防系统中,LMDeploy 能够实时处理监控视频中的图像数据,并结合文本信息进行综合分析,准确识别异常行为,其多模态处理能力使得系统的准确率提高了 20%以上。

- TensorRT-LLM 是 NVIDIA 提供的高性能深度学习推理 SDK,构建于 TensorRT 之上,专门为大型语言模型(LLMs)推理进行了深度优化。它通过图优化、Kernel Fusion 和量化等技术,显著提升推理速度并降低显存占用。TensorRT-LLM 针对 Transformer 架构进行了定制优化,支持多种精度的量化,适用于 NVIDIA GPU 上的高性能推理,尤其是在需要极致速度和低延迟的场景。

7.3 快速开发与 API 部署选型

在快速开发和 API 部署的场景中,选择能够提供易于使用的 API 和工具的框架,可以极大地提高开发效率。

- LiteLLM 是轻量级多模型 API 集成的代表。它提供统一的 API 接口,能够无缝支持多种 LLM,极大地简化了多模型集成和管理的复杂性。通过 LiteLLM,开发者可以使用一套 API 接口来调用不同提供商的 LLM,无需针对每个模型进行单独的开发和适配工作,开发效率提高了 50%以上。例如,在某小型创业公司的智能客服系统中,LiteLLM 的轻量级设计使得系统能够在有限的硬件资源下稳定运行,同时支持多种 LLM 的集成,为用户提供高质量的客服体验。

- FastAPI 是一个高性能的 Python Web 框架,专为快速构建 LLM 推理 API 服务而设计。它支持异步操作和自动数据验证,开发效率高且性能卓越。例如,在快速原型开发中,FastAPI 可以在短时间内搭建起一个完整的 API 服务,支持高效的模型推理和数据交互。

- XInference 提供与 OpenAI API 兼容的接口,具备高度的部署灵活性,并原生支持多种模型,能够灵活应对快速变化的应用需求。它支持多种部署选项,包括本地部署、云端部署以及混合部署,能够满足不同用户的需求。例如,在一些需要快速迭代和灵活部署的项目中,XInference 的灵活性使得开发者能够快速调整和优化系统,满足不断变化的业务需求。

7.4 企业级大规模应用选型

对于企业级大规模应用,如实时对话系统、大规模内容生成平台、高性能 AI 服务后端等,选择能够提供高稳定性、可靠性和可扩展性的推理框架是关键。

- vLLM 不仅在高性能推理方面表现出色,还具备企业级的稳定性和可靠性。它支持多种量化方法,能够根据企业的实际需求进行灵活配置。例如,在某大型互联网企业的智能客服系统中,vLLM 的高吞吐量和低延迟特性使得系统能够实时处理海量用户请求,极大地提高了用户体验。

- LMDeploy 以其极致的 GPU 性能和多模态处理能力,成为企业级应用的理想选择。它对国产 GPU 的深度适配,为企业提供了更多的硬件选择。例如,在某智能安防系统中,LMDeploy 的多模态处理能力使得系统能够实时处理监控视频中的图像数据,并结合文本信息进行综合分析,准确识别异常行为,其多模态处理能力使得系统的准确率提高了 20%以上。

- TGI (Text Generation Inference) 是一个专为大规模文本生成任务优化的推理框架,特别关注推理性能和资源效率。它与 Hugging Face 的模型生态系统紧密集成,提供了完整的模型部署解决方案。TGI 支持高并发请求处理,并提供自动扩缩容能力,能够满足企业级应用的需求。例如,在某内容生成平台中,TGI 的高性能和稳定性使得系统能够高效地生成高质量的文本内容,满足大规模用户的需求。

选择推理框架时,需综合考虑吞吐量需求、硬件预算、合规要求和技术栈适配性。建议通过压力测试验证框架在实际业务场景中的表现,同时关注社区活跃度(GitHub star增长趋势)和商业支持选项。

如何系统学习掌握AI大模型?

AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量。抓住AI大模型的风口,掌握AI大模型的知识和技能将变得越来越重要。

学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。

这里给大家精心整理了一份

全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

1. 成长路线图&学习规划

要学习一门新的技术,作为新手一定要先学习成长路线图,方向不对,努力白费。

这里,我们为新手和想要进一步提升的专业人士准备了一份详细的学习成长路线图和规划。可以说是最科学最系统的学习成长路线。

2. 大模型经典PDF书籍

书籍和学习文档资料是学习大模型过程中必不可少的,我们精选了一系列深入探讨大模型技术的书籍和学习文档,它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。(书籍含电子版PDF)

3. 大模型视频教程

对于很多自学或者没有基础的同学来说,书籍这些纯文字类的学习教材会觉得比较晦涩难以理解,因此,我们提供了丰富的大模型视频教程,以动态、形象的方式展示技术概念,帮助你更快、更轻松地掌握核心知识。

4. 2024行业报告

行业分析主要包括对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

5. 大模型项目实战

学以致用 ,当你的理论知识积累到一定程度,就需要通过项目实战,在实际操作中检验和巩固你所学到的知识,同时为你找工作和职业发展打下坚实的基础。

6. 大模型面试题

面试不仅是技术的较量,更需要充分的准备。

在你已经掌握了大模型技术之后,就需要开始准备面试,我们将提供精心整理的大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以

微信扫描下方CSDN官方认证二维码,免费领取【保证100%免费】