作者:Yuting Zhou; Xuemei Yang; Shiqi Liu; Junping Yin

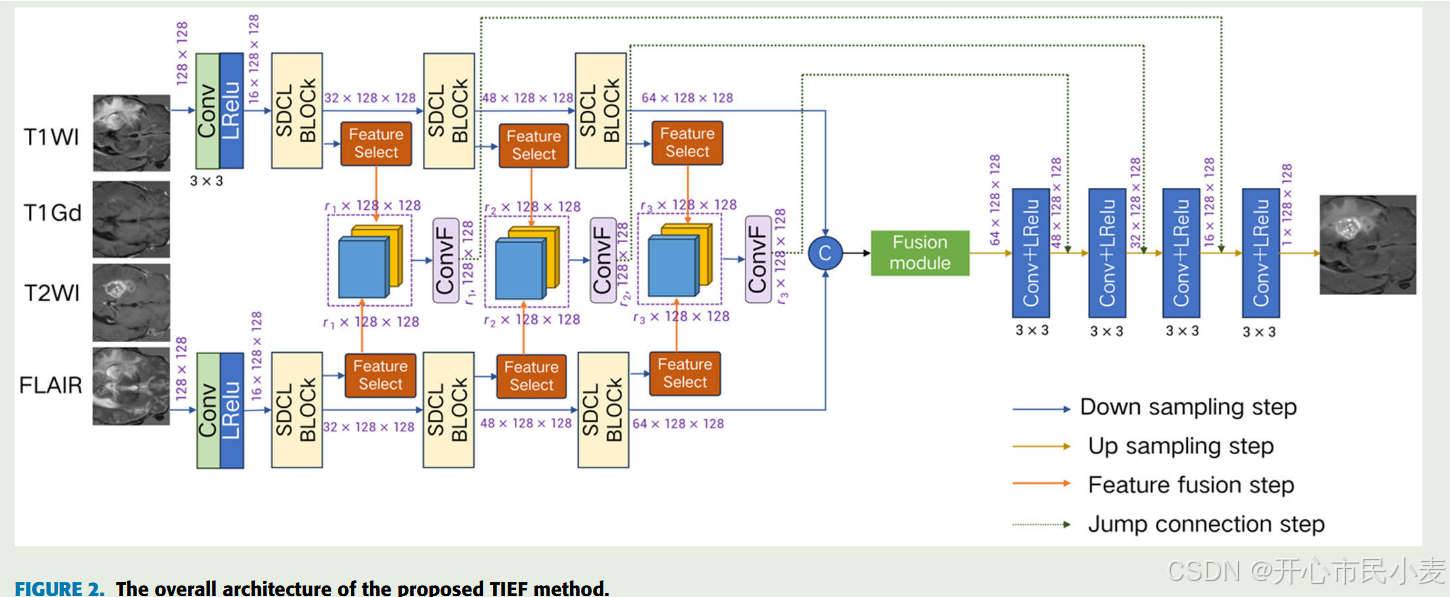

方法:研究提出了一种多模态MRI图像融合方法,通过引入基于信息熵的特征信息测量块、融合块和新损失函数,旨在增强图像的纹理信息和结构清晰度,并通过跨模态学习与信息增强技术实现不同模态下肿瘤特征的显著呈现。

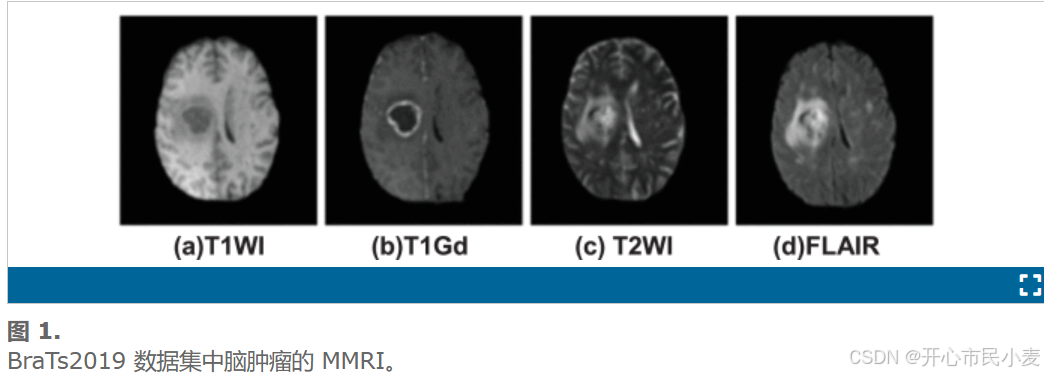

MMRI 代表 MRI 的不同序列。不同的 MRI 序列提供了有关脑组织和解剖特征的不同细节。临床医生将结合多种模式的 MMRI 来综合判断肿瘤的情况。近年来,MMRI 已成为精确和个性化医疗保健不可或缺的工具 。与涉及电离辐射的技术不同,MRI 不受采样误差和内部变化的影响。图 1 显示了通过各种 MRI 序列获得的一组脑肿瘤图像。对图 1 的观察揭示了不同序列的独特特征。T1 加权成像序列 (T1WI) 呈现清晰的解剖结构,但未能清楚地描绘病变。相比之下,T1 加权增强扫描成像序列 (T1Gd) 突出显示了血流活跃的区域,这是突出肿瘤的关键标准。T2 加权成像序列 (T2WI) 显示相对简单的图像,有助于整体肿瘤评估。抑制脑脊液中高信号的液体衰减反转恢复图像序列 (FLAIR) 描绘了瘤周水肿区域。这些不同的成像模式捕获了额外的病理信息。鉴于单个成像模式的局限性,图像融合旨在将多模态图像合并为统一输出,合并互补信息,以促进增强人类视觉感知和自动肿瘤检测。多模态脑部 MRI 图像融合有助于更精确地了解病灶形状、组织结构和相对空间位置 ,有助于设计更准确的个体化治疗计划。

问题背景

然而,由于卷积运算的局部性[18],他们需要帮助来获取全面的全局知识。

Transformer模型主要关注域内的全局信息,忽略了图像融合任务中至关重要的跨域集成。这种方法面临着区分目标体积(如增强的肿瘤和背景)的挑战。

目前,损失函数的设计大多局限于全局像素信息水平,这不足以形成比源图像更好的融合图像,并限制了融合图像的质量,从而限制了图像融合在医学应用中的适用性

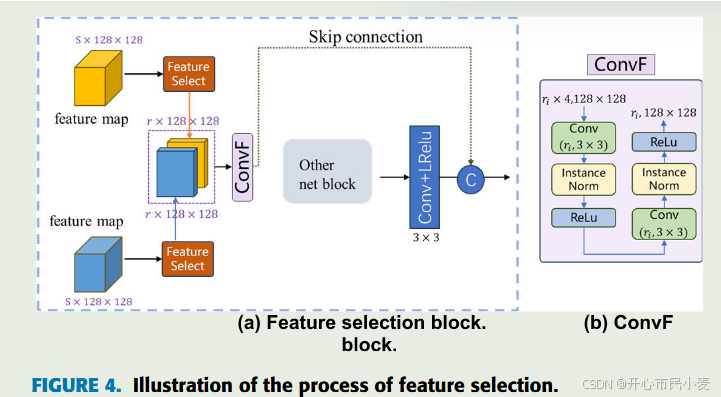

虽然一些方法的融合结果也包含丰富的纹理细节,但它们没有显著的对比度,无法清楚地区分目标和背景。包含丰富纹理信息和边缘信息的特征仅存在于特定的特征通道中。使用所有浅层特征进行融合会降低模型的融合效果。

创新点:

针对上述问题,本文提出了一种基于特征选择和注意力机制的脑肿瘤 MMRI 融合网络:TIEF。该网络的脑肿瘤融合图像包含清晰的大脑结构和解剖信息。更重要的是,它整合了水肿部分、强化肿瘤、坏死肿瘤核心的多种模态描述,各区域的判别度明显,可为医生提供更精准、更准确的肿瘤信息。这项工作对多个方面都有重大贡献。

-

我们提出了一个基于信息熵的特征信息测量块,这是一种简单而强大的工具,可以有效地测量特征信息。此模块在编码和解码阶段之间建立高效的跳过连接,过滤高细节和纹理丰富的特征通道,以增强特征重用。

-

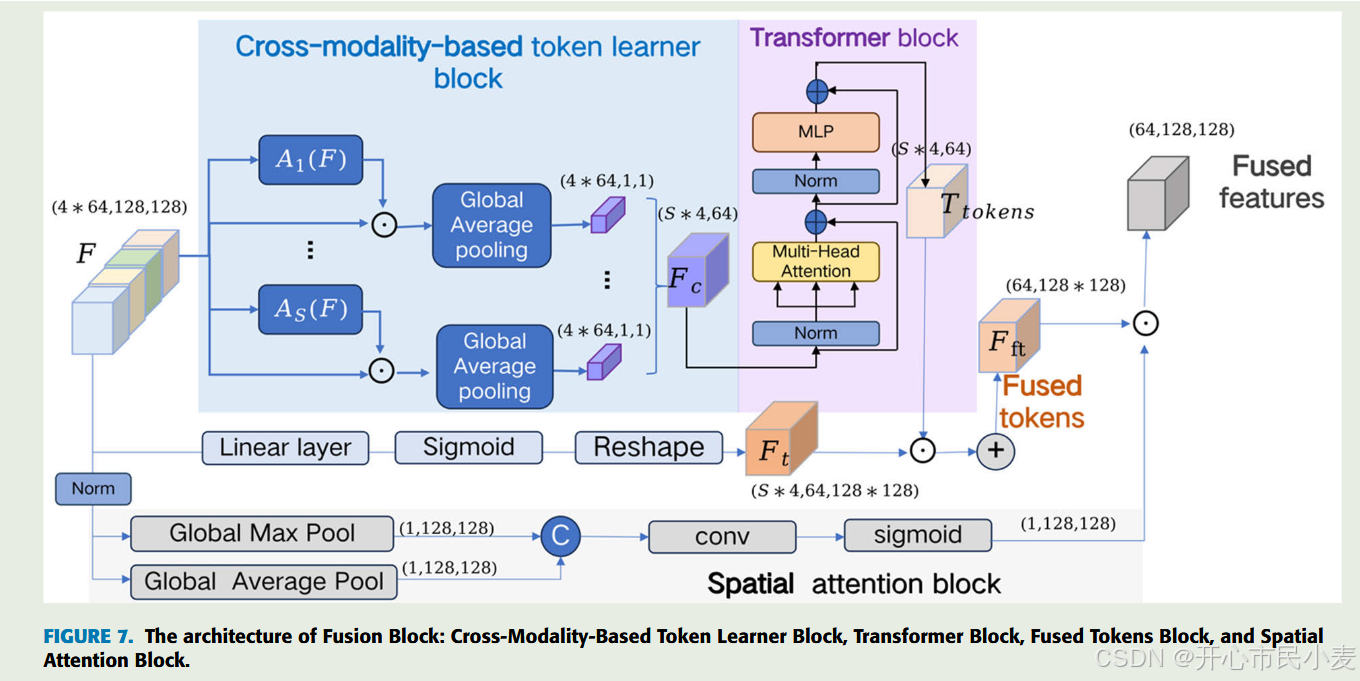

我们设计了一个融合块,旨在提取和合并多模态深度特征。该模块由基于跨模态的词元学习器模块、transformer 模块、词元融合模块和空间注意力模块组成,可动态识别输入多模态深度特征中的关键区域,从而实现空间和跨模态融合。

-

我们提出了一种新的损失函数,它结合了模态和组织加权,利用区域对比指数。此功能控制源图像中信息的保留程度,并专注于各种医疗应用中至关重要的感兴趣区域。

方法:研究提出了一种多模态MRI图像融合方法,通过引入基于信息熵的特征信息测量块、融合块和新损失函数,旨在增强图像的纹理信息和结构清晰度,并通过跨模态学习与信息增强技术实现不同模态下肿瘤特征的显著呈现。

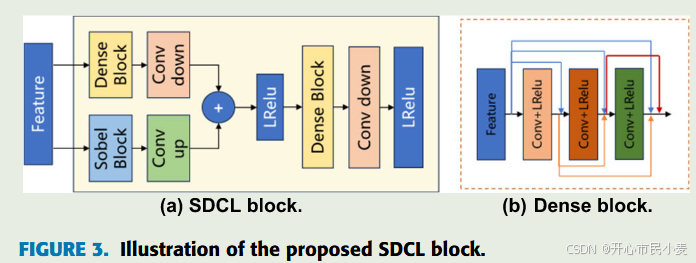

SDCL-Block增强编码阶段的特征提取

为了增强编码阶段的特征提取,我们设计了一个新的SDCL块,如图3所示,采用双并行结构。一个分支包含一个密集块,优化了通过各种卷积层提取的特征的利用率。另一个分支采用梯度运算来计算特征梯度幅度,重点是纹理信息提取。Conv-up和Conv-down级结合了1×1卷积层,以标准化双分支结构特征中的信道计数。随后,另一项操作整合了从双分支获得的深度和细节特征。SDCL块的后半部分通过重复密集块结构进一步强调了特征整合,增强了提取特征的传播强度。

A-特征选择

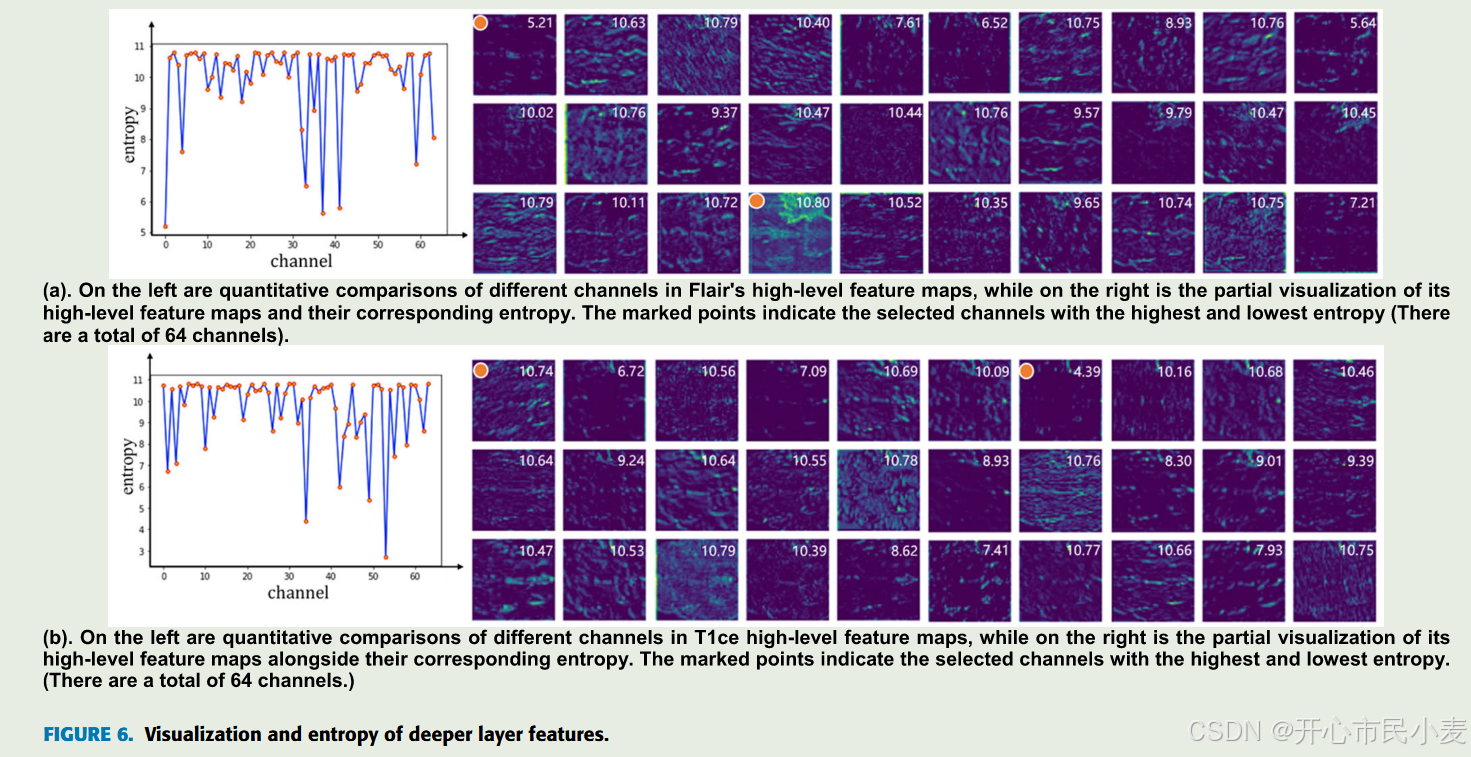

信息熵计算的作用及应用:计算不同深度和通道特征图的信息熵,可辨别特征信息丰富度和特征图熵之间的关系,有助于识别与人类视觉更接近的特征图。从计算结果可知,不同通道提取信息不同,熵值高的通道在肿瘤区域有更丰富纹理细节和突出像素,利于视觉肿瘤检测。为优化解码阶段融合图像重建,需选择信息丰富的特征图(尤其是高熵通道),本研究在每层计算排序所有信道特征熵值后,选择熵最大的r个信道(r=8)。同时,仅选空间信息丰富特征可能无法全面表示图像内容,因此将特征选择模型作为网络分支,通过跳过连接解决解码中的关键特征问题。

左侧图:分别是 Flair 和 T1ce 高级特征图不同通道的信息熵定量比较,横坐标为通道数,纵坐标为熵值。

右侧图:是对应高级特征图的部分可视化及其相应的熵值,图中右上角数值是根据公式 (1) 计算的信息,左上角圆圈表示信息熵大于阈值的通道,标记点表示选择的熵值最高和最低的通道(总共有 64 个通道)。从图中可看出同一层不同通道关注不同细节和区域,高熵通道在肿瘤区域表现更优 。

B-特征融合

挖掘和整合多模态深度特征的模块。包括基于跨模态的令牌学习器块、变换器块、令牌融合块和空间注意力块

在基于跨模态的令牌学习器块生成令牌并由变换器块进行后续处理之后,采用融合令牌块进一步合并令牌之间的信息。此功能有助于模型捕获由这些标记形成的跨模态“模式”。基于跨模态的标记学习器块和融合标记块之间的协同作用旨在有效地融合模态内和模态间的深度特征,确保互补信息的稳健集成。

跨模态token学习块

方法使令牌能够动态地调整其空间选择,而不是对输入张量进行固定分割。这些不同的标记有效地挖掘了模态内和模态间的深层特征,从而能够对它们的关系和交互进行建模。将得到的标记聚合形成学习标记张量V∈RSI×C。本文采用S=8。随后,将学习到的令牌张量转发给后续的变换器块。

损失函数

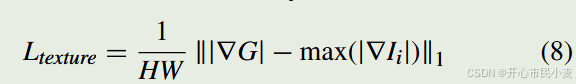

Texture Loss纹理损失

不同的源图像表现出不同的特征,如独立单位、信噪比、体素计数、空间平滑度和强度分布。相同形态但不同区域的图像具有整体结构相似性,但表现出不同的具体细节和纹理。融合图像的目的是在保留复杂纹理细节的同时,弥合模态异质性引起的细节差距。通过特征可视化实验,本文确定了一个最优的纹理损失函数。此功能通过融合图像的不同模式来保留更多的纹理信息。同时,为了减少图像细节的损失,损失函数引入了Canny算子来描绘纹理中的细微差异。考虑到这些因素,我们制定了纹理损失的公式,以鼓励融合图像包含更丰富的纹理信息。

实验

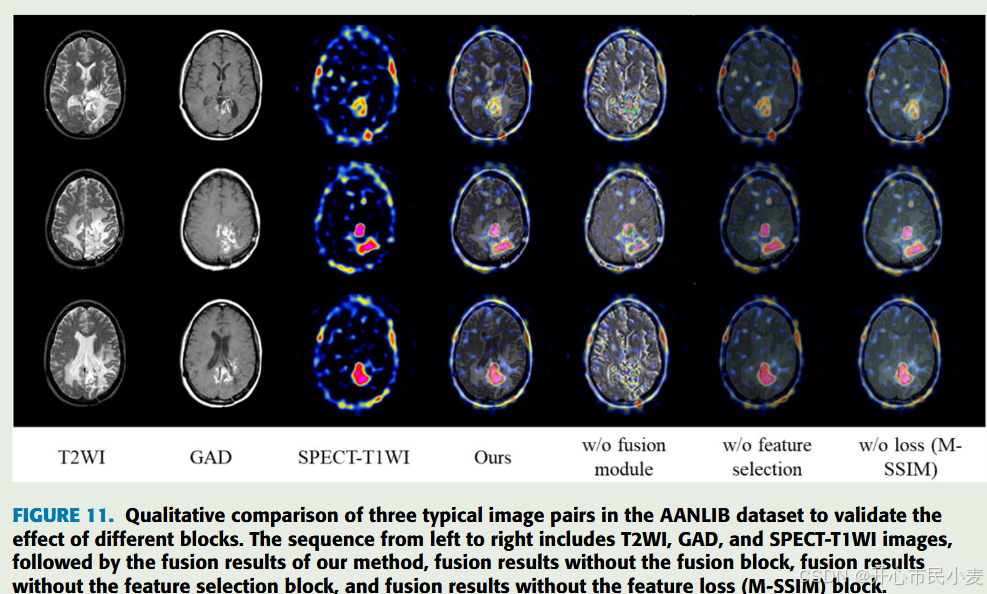

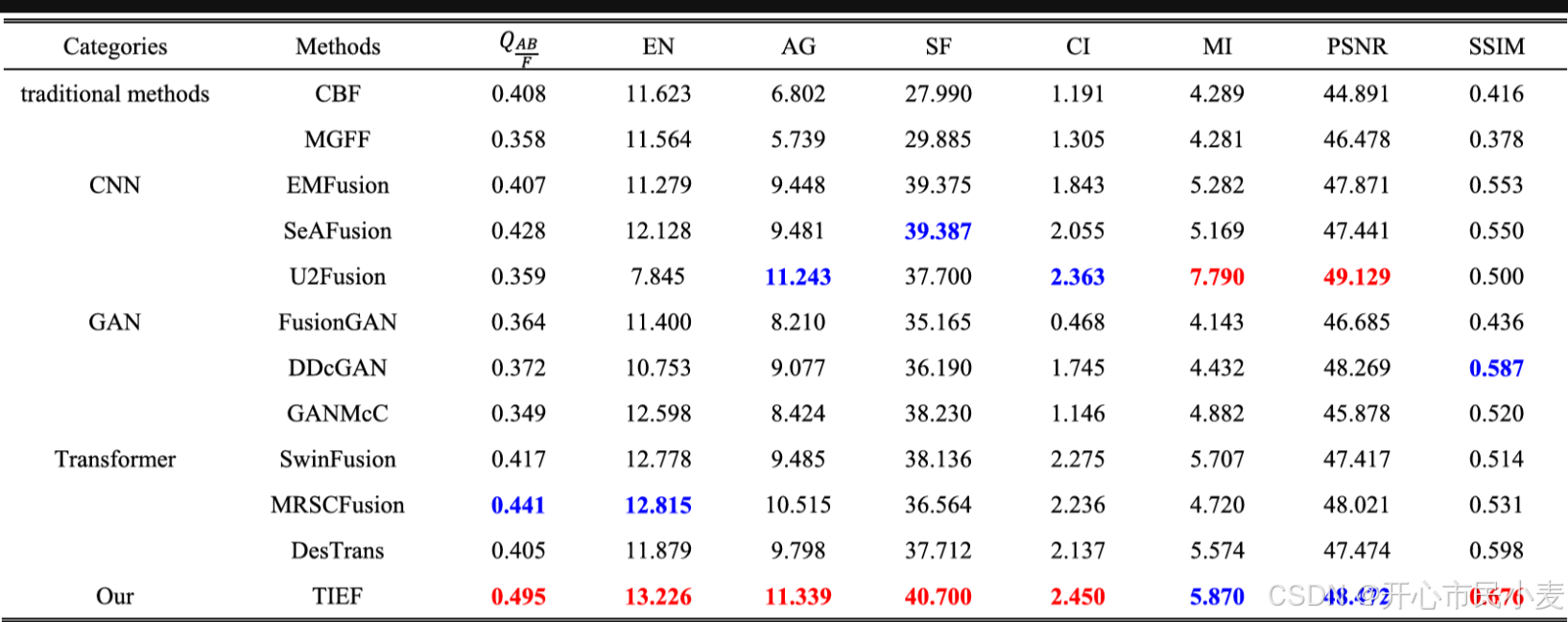

融合块更好地整合了原始图像信息和融合成像。这突显了它在产生高质量聚变结果方面的关键作用。在这项研究中,将特征选择块增强融合结果的基线方法与TIEF进行了比较,消除了特征选择块的影响。例如,尽管来自T2WI第一行的图像边缘纹理信息非常突出,但这一细节必须在融合结果中得到准确表示。通过我们的比较,使用特征选择块的优势变得更加明显。与单独使用基线方法相比,具有特征选择块的基线方法显著提高了评估指标。从表中的比较分析可以看出,缺乏特征选择降低了融合结果中源图的信息丰富性。实验结果表明,特征选择块显著提高了网络的融合效果。此外,还研究了在实验中添加损耗功能块的影响。添加该块显著改善了EN、AG、CI、MI、PSNR和其他评估指标。比较TIEF方法在添加或不添加损失功能块的情况下,证实了其在增强不同肿瘤组织之间对比度方面的重要性。该图显示,在没有损失函数的情况下,融合结果的配对比较可能会更好,突显了TIEF的优越性。对AANLIB数据集进行了相同的测试。图11显示,没有融合块的实验结果偏离了图像的来源,并扭曲了颜色部分。实验中缺少特征选择块导致明显缺乏详细信息,从而导致图像模糊。同样,当实验缺少损失函数块时,前后场景的对比度显著降低。表。4还从不同角度说明了融合、特征选择和损失函数块的不同效果。