1. 什么是最大似然估计?

在一次机器语言的学习中,引入了一个新概念—最大似然估计。然而面对繁琐的数学公式和复杂的推理过程,使我对概念非常模糊,也不懂到底是什么原理,但通过后来的慢慢学习使我对最大似然估计有了不一样的认识。

最大似然估计是使用概率模型、利用已知的样本结果,反推一件事情最有可能发生(最大概率)导致这样结果的参数值,是一类完全基于统计的系统发生树重建方法的代表,可以理解为样本所展现的是所有可能状态中概率最大的状态。这种对复杂问题概念的求解问题使我联想到贝叶斯公式,在很多求解概率的问题上都离不开它,由此,从贝叶斯公式与最大似然估计两者之间的联系和区别又对最大似然估计方法又有了更深刻的认识。最大似然估计方法为什么受欢迎?他和贝叶斯公式之间最大的不同在哪?最大似然方法估计的原理是什么?既然是通过概率模型进行求解那么在实际问题中应该选用那种模型呢?最大似然估计方法的应用有哪些?

2. 问题分析

在概率论中,了解到贝叶斯公式是一个后验概率,什么是后验概率?简单来说,后验概率是基于“结果”的信息重新修正后的概率,所获得的概率更接近实际情况。但是在实际应用中,样本数据不多,特征值的维度也不够大导致直接计算条件概率的难度较大,所以最大似然估计方法相当于贝叶斯公式的升级版,将概念密度估计转化成了参数估计,在样本数量无限多时,结果会更接近于真实值,这对我们日常生活中处理概率问题有很大帮助,这也是为什么最大似然估计这么受欢迎的原因。

同时,两者最大的区别也就出现了,那就是参数。非常能够总结最大似然估计的一句话是“模型已定,参数未知”,通过若干次试验观察其结果,得到某个参数值使样本出现的概率最大,是一种在实际问题求解中的简化方法。最大似然估计方法是建立在最大似然原理之上的,极大似然估计是建立在极大似然原理的基础上的一个统计方法,如果单从概念不能完全理解,就用一个简单的例子来介绍最大似然原理:

有两个形状大小一样的箱子里面各有10个球,第一个箱子里面有2个红球8个篮球,另一个箱子里有8个红球2个篮球,当问你觉得红色球是从哪个箱子里拿出来的时候,人们都会觉得是从第二个箱子里面拿出来的,这个推断符合日常生活中的经验事实,而最大可能就是最大似然之意,这种想法也被称为最大似然原理。这样理解起来是不是就会更容易!

接下来,就是最大似然估计模型的推导过程:

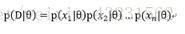

假设样本集D={x1 、x2 、…、xn},假设样本之间都是相对独立的,注意这个假设很重要!于是便有:

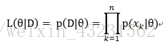

所以假设似然函数为:

接下来我们求参的准则便是如名字一样最大化似然函数喽:

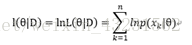

引入拉普拉斯修正,也就是取对数ln,所以做出下面变换:

所以最大化的目标便是:

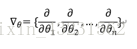

再使用数学中的微分知识求解:

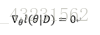

最后使偏导数为0:

由此得到参数θ,求出类条件概率密度进行判别

通过对似然估计的推导,是不是对其有更清晰的认识了呢~

-

应用

大家肯定会问,最大似然估计到底有什么用?

其实最大似然估计在科学、医疗、经济等领域上都有广泛的应用

例如:

求取广义线性模型之最大似然估计:

应用于求取乳腺癌死亡率之小区域估计

最大似然估计在保险精算中的应用研究

最大似然估计在GPS定位中的应用研究

最大似然估计的信息融合方法及其在水下航行器制导中的研究

关于截尾样本情形下的最大似然估计

基于最大似然估计的雷达高度计跟踪处理

广义最大似然估计在OCT无创血糖检测中的应用 -

总结

求最大似然估计量的一般步骤:

(1)写出似然函数;

(2)对似然函数取对数,并整理;

(3)求导数;

(4)解似然方程。

这篇文章对最大似然估计的概念以及基本推导过程进行叙述和展示,希望对一样有需求的人有帮助,最大似然估计的应用广泛,比其他估计方法更简单,当样本数量较多时收敛性也会非常好,在应用中需要结合特定的环境,因为它需要你提供样本的已知模型进而来估算参数,假设类条件概率模型正确,通常都能获得较好的结果。

参考文献:《应用概率统计》