指数加权平均

假设有多个时间点对应的值

θt,那么我可以得出一个指数加权平均值

Vt:

{Vt=0Vt=βVt−1+(1−β)θtt=0t>0

在结果上看,

Vt可以看成以

t结尾的

1−β1天的平均

θ值。

当

β=0.9时有:

Vt=0.1θt+0.1⋅0.9θt−1+0.1⋅0.92θt−2+0.1⋅0.93θt−3+...

当超过

1−β1时,其系数小于

e1,影响较小了。

空间优势:

假设我不需要保留前一个数据,那么只需要

V:=βV+(1−β)θt,也就是说,我只需要开一个与

θt相同大小的数据即可实现这一过程,而不像直接取平均值那样要保留其它项。空间优势巨大。

指数加权平均……偏差修正

开始的几天并不正确,因为虽然乘了系数,但是项数却不够,所以可以进行修改,使得

Vt:=1−βtVt

验证以下可以发现,前面几项除了一个小数,变大了,也就是说趋近了真实的值。

momentum(动量)梯度下降法

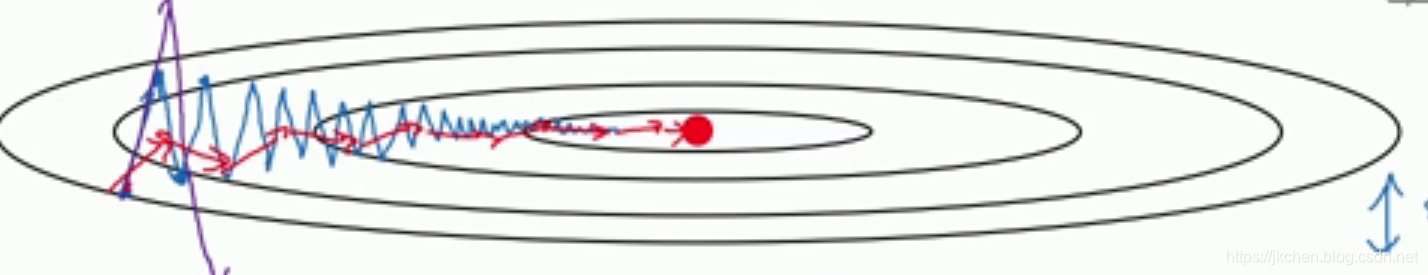

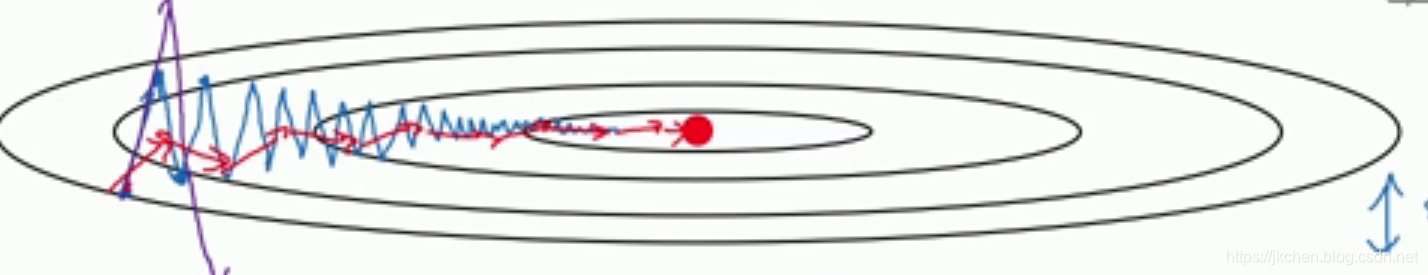

类似与上述的情况下,梯度下降会按照蓝色的线进行优化参数。

我们想要减少垂直方向的变化幅度,加大水平方向的变化。

考虑指数加权平均的方法。

我们在神经网络中,算出了

dw,db,然后令:

Vdw:=βVdw+(1−β)dwVdb:=βVdb+(1−β)dbw:=w−α⋅Vdwb:=b−α⋅Vdb

思索一下这样的做法对原来的梯度下降法的优化,如果遇到上面的情况,上下的起伏因为平均后变得很小。而左右方向的前进速度因为一直累加而变大。

所以说,在大部分情况下,momentum梯度下降法都是快于原来的梯度下降法的。