一)简介

VGG Net由牛津大学的视觉几何组(Visual Geometry Group)和 Google DeepMind公司的研究员一起研发的的深度卷积神经网络,在 ILSVRC 2014 上取得了第二名的成绩。它主要的贡献是使用小尺寸滤波器,对网络深度进行大幅增加,展示出网络深度(推进到16-19层)对模型效果有显著提高。

二)VGGNet模型解析

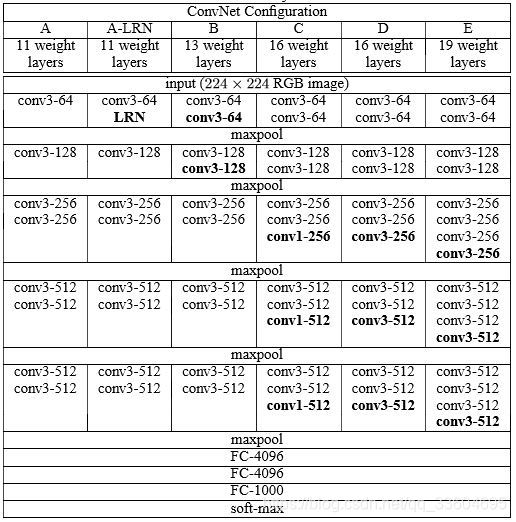

论文中展示了一系列不同的VGG模型结构,如下图所示。

图中所有的网络都基于通用结构设计,只是深度不同:

A包含11个权重层一一8个卷积层,3个全连接层;

……

E包含19个权重层一一16个卷积层,3个全连接层;

右边的网络均基于A,实验表明最后两组,即深度最深的两组16和19层的VGGNet网络模型在分类和定位任务上的效果最好。

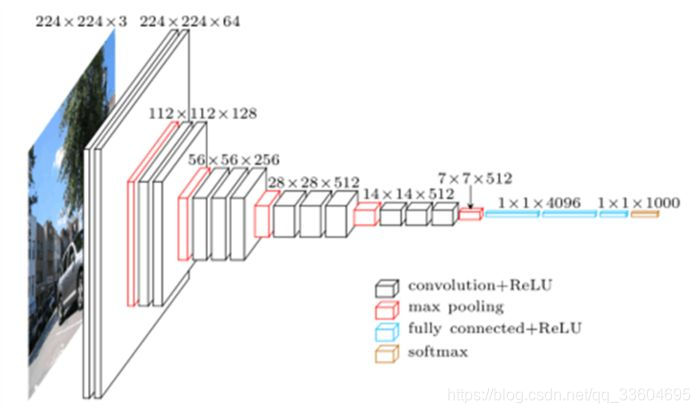

2.1)VGG-16网络结构

下面VGG-16的网络结构图,在Netscope上有更清晰的展示,大家可以自行前往,而且对每层有大致的描述:http://ethereon.github.io/netscope/#/gist/dc5003de6943ea5a6b8b

图像输入

输入是大小为224*224的RGB图像,预处理时计算出三个通道的平均值,在每个像素上减去平均值(处理后迭代更少,更快收敛)。

卷积层C1_1、C1_2

C1_1层:卷积核尺寸3x3,数量64,padding=1,stride=1

ReLU1_1:特征图224x224x64

C1_1层:卷积核尺寸3x3,数量64,padding=1,stride=1

ReLU1_2:特征图224x224x64

池化层P1

MaxPooling:核尺寸2x2,stride=2

特征图112x112x64

卷积层C2_1、C2_2

C2_1层:卷积核尺寸3x3,数量128,padding=1,stride=1

ReLU2_1:特征图112x112x128

C2_2层:卷积核尺寸3x3,数量128,padding=1,stride=1

ReLU2_2:特征图112x112x128

池化层P2

MaxPooling:核尺寸2x2,stride=2

特征图56x56x128

卷积层C3_1、C3_2、C3_3

C3_1层:卷积核尺寸3x3,数量256,padding=1,stride=1

ReLU3_1:特征图56x56x256

C3_2层:卷积核尺寸3x3,数量128,padding=1,stride=1

ReLU3_2:特征图56x56x256

C3_3层:卷积核尺寸3x3,数量128,padding=1,stride=1

ReLU3_3:特征图56x56x256

池化层P3

MaxPooling:核尺寸2x2,stride=2

特征图28x28x256

卷积层C4_1、C4_2、C4_3

C4_1层:卷积核尺寸3x3,数量512,padding=1,stride=1

ReLU4_1:特征图28x28x512

C4_2层:卷积核尺寸3x3,数量512,padding=1,stride=1

ReLU4_2:特征图28x28x512

C4_3层:卷积核尺寸3x3,数量512,padding=1,stride=1

ReLU4_3:特征图28x28x512

池化层P4

MaxPooling:核尺寸2x2,stride=2

特征图14x14x512

卷积层C5_1、C5_2、C5_3

C5_1层:卷积核尺寸3x3,数量512,padding=1,stride=1

ReLU5_1:特征图14x14x512

C5_2层:卷积核尺寸3x3,数量512,padding=1,stride=1

ReLU5_2:特征图14x14x512

C5_3层:卷积核尺寸3x3,数量512,padding=1,stride=1

ReLU5_3:特征图14x14x512

池化层P5

MaxPooling:核尺寸2x2,stride=2

特征图7x7x512

全连接层FC6

FC6:4096个7x7卷积核,映射到4096个神经元

ReLU6

Drop6:dropout ratio=0.5

全连接层FC7

FC7:4096个神经元,与FC6的神经元全连接

ReLU7

Drop7:dropout ratio=0.5

全连接层FC8

FC8:1000个神经元,与FC6的神经元全连接

softmax输出层

完成分类任务

2.2)VGG网络分析

相比于AlexNet,VGGNet用以下特点值得大家思考。

https://blog.csdn.net/qq_40027052/article/details/79015827