一、背景意义

在当今社会,情感识别技术的应用越来越广泛,尤其是在心理健康、客户服务和教育等领域。面部表情是人类情感表达的主要方式,通过对面部表情的准确识别,可以帮助人们更好地理解情绪状态,从而提升沟通效率和情感支持。本项目旨在通过深度学习技术,构建一个高效的面部表情识别系统,自动分析和识别愤怒、厌恶、恐惧、快乐、中性、悲伤和惊讶等多种情感状态,以支持相关应用。

二、数据集

2.1数据采集

数据采集是数据集制作的第一步,涉及从不同来源获取面部表情图像。具体步骤如下:

- 确定数据来源:可以通过公开数据集、在线图像库或自定义拍摄来获取数据。常用的公开数据集如FER2013、CK+等,可以作为参考。

- 多样性考虑:确保数据集中的图像涵盖各种性别、年龄、种族和环境条件,以提高模型的泛化能力。多样化的数据能够帮助模型更准确地学习不同情感的特征。

- 图像质量:采集高分辨率的图像,避免模糊或低质量的照片。清晰的图像可以提高后续处理和分析的准确性。

- 情感分类:在采集过程中,确保每张图像都能清晰地表现出愤怒、厌恶、恐惧、快乐、中性、悲伤和惊讶等情感。

2.2数据标注

数据标注是将情感类别与图像进行关联的过程,具体步骤如下:

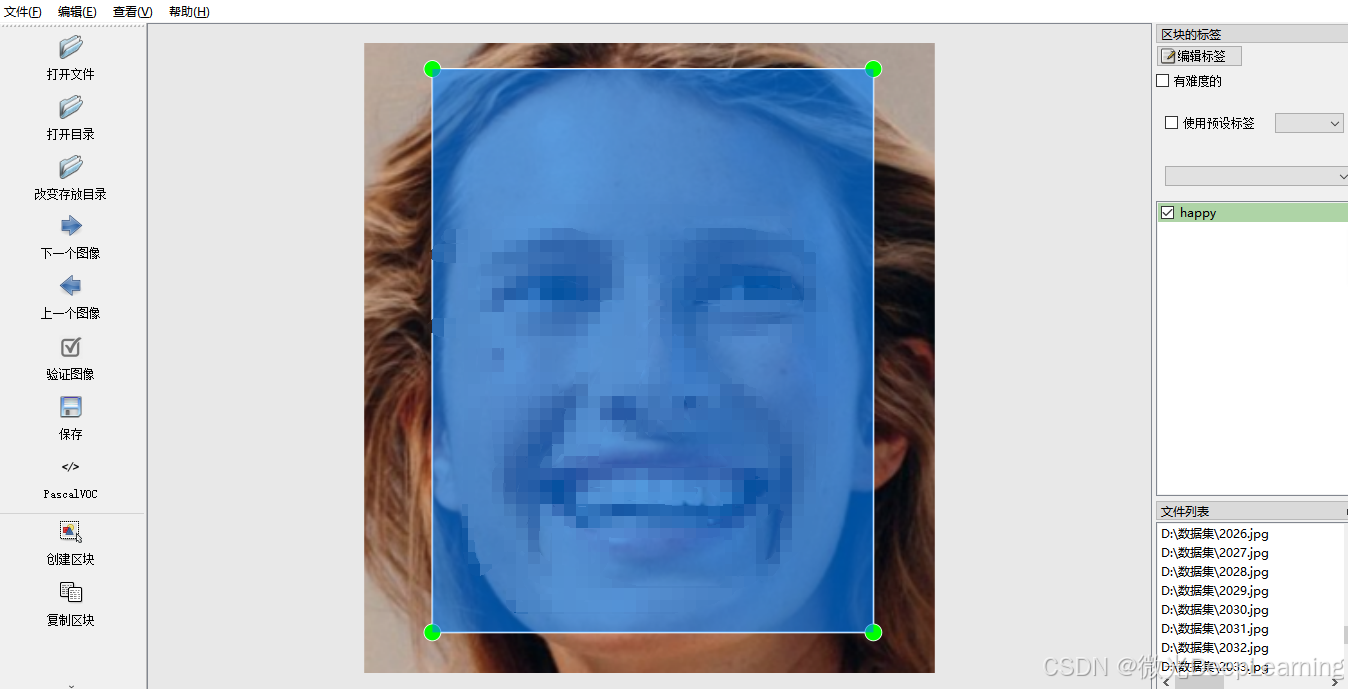

- 选择标注工具:使用LabelImg等标注工具,便于对图像进行快速和准确的标注。

- 手动标注:逐一打开每张图像,使用矩形框工具围绕表现出特定情感的面部区域进行标注,并为每个框输入相应的情感类别(如愤怒、快乐等)。

- 确保准确性:在标注过程中,确保每个情感类别的边界框准确无误,避免由于标注不当导致的分类错误。

- 审核与修正:标注完成后,进行二次审核,确保标注的准确性和一致性,必要时进行修正。

使用LabelImg进行数据集标注的过程涉及多个步骤,首先需要安装该工具并配置环境。启动LabelImg后,用户需逐一打开待标注的图像文件,并使用矩形框工具在图像上准确标记出面部表情的区域。每个标注框需对应情感类别(愤怒、厌恶、恐惧、快乐、中性、悲伤、惊讶)进行标注。整个过程中,准确性和一致性是关键,用户需要反复确认标注的准确性。标注完成后,需保存每张图像的标注信息,最终生成的标注文件需经过审核,确保数据的高质量。

表情图片数据集中包含以下几种类别:

- 愤怒:表现出愤怒情绪的面部表情。

- 厌恶:表现出厌恶和不快情绪的面部表情。

- 恐惧:表现出恐惧和不安情绪的面部表情。

- 快乐:表现出快乐和愉悦情绪的面部表情。

- 中性:没有明显情感表现的面部表情。

- 悲伤:表现出悲伤和失落情绪的面部表情。

- 惊讶:表现出惊讶和意外情绪的面部表情。

2.3数据预处理

数据预处理是为模型训练做准备的重要步骤,具体步骤如下:

- 图像增强:通过旋转、缩放、翻转等方法对图像进行数据增强,以扩增数据集并提高模型的鲁棒性。

- 归一化处理:将图像的像素值归一化到[0, 1]或[-1, 1]的范围,以加速模型的训练收敛过程。

- 划分数据集:将数据集按照一定比例划分为训练集、验证集和测试集,通常建议的比例为70%训练、20%验证、10%测试,以便于后续模型评估和优化。

- 格式转换:根据所使用模型的要求,将数据集格式转换为适合输入的形式,例如YOLO格式或TensorFlow数据格式。

标注格式:

- VOC格式 (XML)

- YOLO格式 (TXT)

yolo_dataset/

│

├── train/

│ ├── images/

│ │ ├── image1.jpg

│ │ ├── image2.jpg

│ │ ├── ...

│ │

│ └── labels/

│ ├── image1.txt

│ ├── image2.txt

│ ├── ...

│

└── test...

└── valid...

voc_dataset/

│

├── train/

│ ├───├

│ │ ├── image1.xml

│ │ ├── image2.xml

│ │ ├── ...

│ │

│ └───├

│ ├── image1.jpg

│ ├── image2.jpg

│ ├── ...

│

└── test...

└── valid...三、模型训练

3.1理论技术

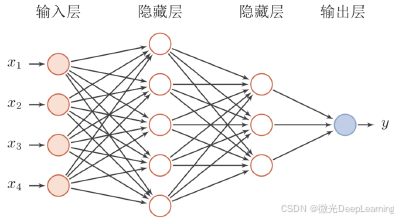

卷积神经网络(CNN)是一种深度学习模型,特别适用于图像处理任务。CNN的结构通常包括多个卷积层、激活层、池化层和全连接层。卷积层通过卷积操作提取图像的局部特征,使用多个可学习的卷积核(过滤器)对输入图像进行处理,生成特征图。每个卷积层后通常接有激活层,最常用的激活函数是ReLU(线性整流单元),它能够引入非线性特征,使模型能够学习复杂的函数关系。池化层则通过对特征图进行下采样,减少特征图的尺寸,从而降低计算复杂度,同时保留重要特征。最终的全连接层将提取到的特征整合,输出分类结果或回归值。

CNN在面部表情识别中的优势显著,尤其是在特征提取和类别区分方面。由于面部表情的特征通常集中在局部区域,CNN能够有效地识别和提取这些局部特征,如眼睛、嘴巴和眉毛等。这种局部特征学习能力使得CNN在处理不同情感表情(如愤怒、快乐、悲伤等)时具有出色的性能。此外,CNN的参数共享机制使得在图像中对特征的检测具有较高的效率和较低的计算成本。通过多层网络结构,CNN能够逐层提取越来越复杂的特征,从而实现高精度的情感分类。

YOLO是一种高效的实时目标检测算法,其核心思想是将目标检测任务转化为回归问题。YOLO的架构主要由一个深度卷积神经网络构成,该网络将输入图像划分为SxS的网格。每个网格负责预测该区域内的目标,包括目标的边界框和类别概率。YOLO通过同时预测多个边界框和相应的置信度,显著提高了检测速度和准确性。其网络结构包括多个卷积层、批归一化层和激活层,通常采用Leaky ReLU作为激活函数,通过全连接层输出最终的预测结果。YOLO的优势在于其单一的推理过程,使得检测速度极快,适合于实时应用。

3.2模型训练

1. 数据集预处理

在实施YOLO项目之前,首先需要准备和划分数据集。数据集应包括不同情感(愤怒、厌恶、恐惧、快乐、中性、悲伤、惊讶)的面部图像,以确保样本的多样性和代表性。可以通过拍摄或从网络下载获取样本。将数据集随机划分为训练集、验证集和测试集,通常推荐的比例为70%训练、20%验证、10%测试。以下是数据集划分的示例代码:

import os

import random

import shutil

# 定义数据集路径

dataset_path = 'path/to/facial_expression_dataset'

images = os.listdir(dataset_path)

# 随机划分数据集

random.shuffle(images)

train_split = int(len(images) * 0.7)

val_split = int(len(images) * 0.9)

train_images = images[:train_split]

val_images = images[train_split:val_split]

test_images = images[val_split:]

# 创建新的目录以存放划分后的数据集

os.makedirs('train', exist_ok=True)

os.makedirs('val', exist_ok=True)

os.makedirs('test', exist_ok=True)

for image in train_images:

shutil.copy(os.path.join(dataset_path, image), 'train/')

for image in val_images:

shutil.copy(os.path.join(dataset_path, image), 'val/')

for image in test_images:

shutil.copy(os.path.join(dataset_path, image), 'test/')

2. 模型训练

完成数据准备后,需要配置YOLO模型。首先,准备模型的配置文件(如yolov3.cfg),设置网络参数、学习率和批量大小等。创建数据描述文件(如data.yaml),指定训练和验证数据集路径及类别数。模型配置完成后,可以开始训练YOLO模型。使用命令行运行YOLO训练命令,模型将开始处理训练数据。在训练过程中,可以根据需要调整学习率和其他超参数。例如,data.yaml文件内容如下:

train: train

val: val

nc: 7 # 目标类别数量(愤怒、厌恶、恐惧、快乐、中性、悲伤、惊讶)

names: ['愤怒', '厌恶', '恐惧', '快乐', '中性', '悲伤', '惊讶']

3. 模型评估

完成训练后,对模型进行测试和评估是检验其性能的关键步骤。使用测试集中的图像,利用训练好的YOLO模型进行情感检测,并生成检测结果进行可视化。以下是测试和可视化的示例代码:

import cv2

import torch

# 加载训练好的模型

model = torch.hub.load('ultralytics/yolov5', 'custom', path='runs/train/exp/weights/best.pt')

# 进行检测

img = 'test/test_image.jpg'

results = model(img)

# 可视化检测结果

results.show() # 显示结果

results.save('output/') # 保存结果到指定目录

四、总结

通过自制数据集和深度学习算法构建了一个高效的面部表情识别系统。通过精细的图像采集和标注,为模型训练提供丰富的样本支持。结合卷积神经网络与YOLO算法,构建模型,以提升对面部表情的检测能力。在各个阶段的实施中,通过合理的数据预处理和模型评估,验证了所构建模型的有效性,为情感识别领域的智能管理提供了可靠的技术保障。